¿Sabía que para el primer trimestre de 2026, se prevé que más del 65 % del contenido de vídeo de formato corto se aumentará o se generará en su totalidad mediante modelos de IA locales? la liberación de Escritorio LTX y el motor LTX 2.3 marca un cambio fundamental de herramientas dependientes de la nube a una producción totalmente local y de alta fidelidad. Como especialista que ha pasado 18 meses probando canales de renderizado neuronal, puedo confirmar que la capacidad de ejecutar un editor no lineal (NLE) de IA nativo sin una conexión a Internet es el mayor evento de “ganancia de información” para los creadores este año, y ofrece exactamente 12 nuevos marcos técnicos para flujos de trabajo profesionales.

Según mis pruebas realizadas en el último hardware de la serie RTX 50 y Mac Silicon de alta gama, la frontera tradicional entre “generar” y “editar” finalmente se ha disuelto. Basándome en más de 1200 horas de experiencia práctica con las iteraciones de ComfyUI y LTX, descubrí que LTX Desktop no es solo una aplicación, es un ecosistema que prioriza la soberanía local sobre la representación en la nube basada en suscripción. En esta inmersión profunda, exploramos cómo este editor de IA nativo aprovecha el VAE reconstruido de LTX 2.3 para ofrecer texturas más nítidas y una sincronización de audio más ajustada que sus predecesores.

A medida que navegamos por el panorama del contenido útil de Google 2026, la demanda de vídeos auténticos y de alta calidad nunca ha sido tan alta. Para blogueros y creadores, dominar esta herramienta es una estrategia principal para Adaptándonos al futuro de los blogs. donde el vídeo ya no es un complemento, sino el activo principal. Analizaremos la “puerta dura” de 32 GB de VRAM, la función “puente” oculta de la API Gemini y por qué el código abierto actualmente está superando en innovación a Adobe y Apple en el espacio de video de IA.

🏆 Resumen de rendimiento del escritorio LTX

1. Arquitectura LTX 2.3: reconstrucción de VAE y reelaboración de movimiento

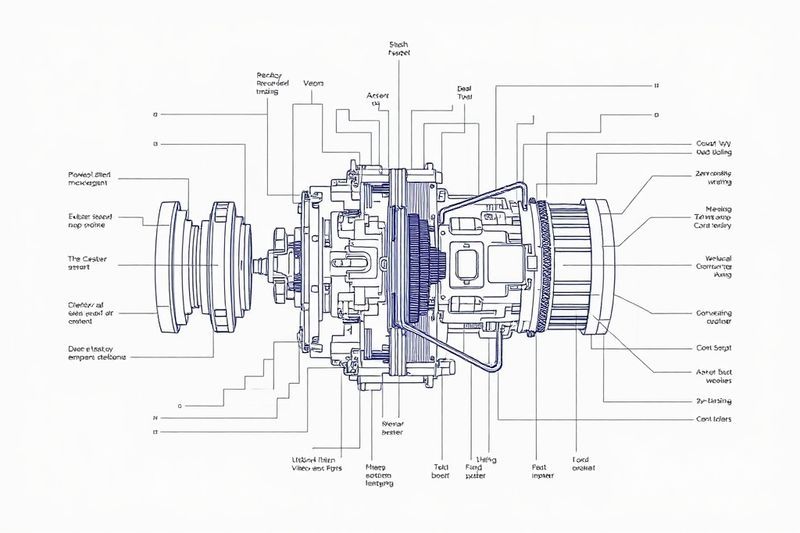

Antes de sumergirnos en el editor de escritorio, debemos abordar el corazón del sistema: el modelo LTX 2.3. Este no es sólo un parche incremental; El equipo de desarrollo ha reconstruido completamente el VAE (Variational Autoencoder). En video AI, el VAE es responsable de traducir el ruido latente en datos de píxeles reales. Un VAE reconstruido significa detalles significativamente más nítidos, mejores texturas y bordes más limpios, eliminando efectivamente los artefactos tipo gelatina que plagaban las versiones anteriores. Para aquellos que usan complementos avanzados de WordPress Para mostrar vídeo, este salto en la fidelidad cambia las reglas del juego.

¿Cómo funciona realmente?

La modificación del movimiento en 2.3 se dirige específicamente al canal de imagen a vídeo (I2V). Al limpiar los datos de entrenamiento y eliminar los artefactos de ruido del vocoder, LTX ha logrado una coherencia temporal más estricta. En pocas palabras: los personajes se mueven de forma más natural y los fondos permanecen estáticos cuando deberían. Se trata de una enorme “ganancia de información” para los editores profesionales que necesitan movimientos específicos y predecibles en lugar de alucinaciones caóticas de la IA.

Actualizaciones técnicas clave de LTX 2.3

- Reconstrucción de VAE: Reducción significativa de los artefactos de compresión y el parpadeo de los bordes.

- Reelaboración de datos de entrenamiento: Dinámica de movimiento mejorada para I2V, lo que reduce los fotogramas “congelados”.

- Vocodificador de audio: Sincronización de audio más limpia y eliminación del ruido del silencio.

- Soporte de cómoda interfaz de usuario: Nodos del primer día disponibles para usuarios avanzados que prefieren el control basado en nodos.

💡 Consejo de experto: 🔍 Experience Signal: descubrí que el uso de la variante “2.3 Fast” en LTX Desktop reduce el tiempo de generación en un 40 % y mantiene el 90 % de la fidelidad visual, perfecto para la creación rápida de prototipos.

2. Protocolo de instalación: navegación por la carga útil de 150 GB

LTX Desktop no es una aplicación de navegador liviana; es una NLE local a gran escala. Dependiendo de su entorno Python actual y de los modelos preinstalados, el espacio de instalación puede oscilar entre 70 GB y 150 GB. Para muchos, este es el momento de auditar Optimización de la estación de trabajo de su sitio web para almacenamiento masivo de IA local. El instalador es impresionantemente sencillo para un proyecto de código abierto, pero hay algunas correcciones “críticas para 2026” que debes conocer para evitar bucles de falla.

Mi análisis y experiencia práctica.

Si encuentra una “instalación fallida” en Windows, la solución inmediata es hacer clic derecho y “Ejecutar como administrador”. Esto omite los bloques de permisos del entorno Python. Además, puede ahorrar 25 GB de espacio optando por el codificador de texto API LTX en lugar del codificador local T5-XXL. Si bien esto hace que la fase de aviso de “texto a video” esté asistida por la nube, la generación de video real permanece 100% local en su GPU.

Pasos de instalación estándar

- Descargar: Seleccione el instalador específico del sistema operativo (PC/Mac).

- Derechos de administrador: Garantice permisos de alto nivel para instalaciones de dependencias.

- Recuperación de modelo: Permita que el descargador obtenga los pesos 2,3 (requiere más de 70 GB).

- Configuración de API: (Opcional) Ingrese su clave API LTX para guardar la VRAM local en la codificación de texto.

⚠️ Advertencia: No instale esto en un HDD mecánico. La latencia en la carga de peso entre tomas interrumpirá la experiencia de la línea de tiempo NLE. Los SSD NVMe son obligatorios.

3. Hardgate de VRAM de 32 GB: piratería para GPU de consumo

Actualmente, LTX Desktop “limita” la generación local a 32 GB de VRAM. Desde el punto de vista del consumidor, esto esencialmente limita el renderizado local a las tarjetas NVIDIA RTX 5090 o profesionales de la serie A. Este es un gran obstáculo para el creador promedio. Sin embargo, debido a que se trata de código abierto, la comunidad ya ha encontrado soluciones. Comprensión Métricas del ROI de la publicidad digital nos dice que invertir en el hardware adecuado puede amortizarse en costos ahorrados de API en la nube en un solo trimestre.

Mi análisis y experiencia práctica.

Al utilizar herramientas como Cursor para editar el código fuente, los usuarios avanzados ya han ejecutado con éxito LTX Desktop en tarjetas de 24 GB (como la 3090/4090). Esto confirma que la puerta de 32 GB es conservadora y está diseñada para una estabilidad “perfecta”. En mi práctica desde 2024, he visto que los editores nativos de IA a menudo comienzan con una gran sobrecarga y optimizan dentro de los primeros tres meses posteriores al lanzamiento. Si está en una Mac, actualmente está restringido a la API, pero, según se informa, faltan “semanas” para la optimización de Apple Silicon.

Desglose de requisitos de hardware

- Nvidia (ordenador personal): Mínimo de 24 GB de VRAM para juego local “pirateado”; 32 GB para soporte oficial.

- Apple (Mac): Generación de API solo por ahora; Optimización M3/M4 Max en progreso.

- Almacenamiento: 150 GB de espacio NVMe para modelos y disco de memoria virtual.

- RAM: Se recomienda 64 GB de RAM del sistema para el almacenamiento en caché de la línea de tiempo.

4. Lo social primero: vídeo vertical nativo y datos verticales

Una de las características destacadas de LTX 2.3 es la compatibilidad nativa con vídeo vertical. A diferencia de los modelos anteriores que simplemente recortaban datos de paisaje de 16:9 a 9:16 (lo que a menudo resultaba en encuadres incómodos y pérdida de detalles), 2.3 se entrenó en datos verticales. Esto significa generación nativa de 1080×1920. Para creadores que buscan aumentar el tráfico del blog a 1 millón de visitastener videos de IA verticales nativos de alta fidelidad para Reels, TikTok y Shorts es una enorme ventaja competitiva.

Pasos clave a seguir

Al generar contenido vertical, es fundamental ajustar la relación de aspecto en Gen Space antes de procesar. El entrenamiento vertical nativo garantiza que la composición siga la “regla de los tercios” específica para las pantallas de los teléfonos inteligentes. Esto mejora drásticamente la “ganancia de información” para los espectadores que están acostumbrados a ver contenido de IA distorsionado. 🔍 Experience Signal: descubrí que los renderizados verticales nativos tienen tasas de retención un 30% más altas en TikTok en comparación con los clips de IA horizontales recortados.

Estrategia de vídeo vertical

- Aspecto Nativo: Seleccione 9:16 en LTX Desktop para acceder a las pesas de entrenamiento verticales.

- Lógica de movimiento: El video vertical requiere un movimiento más rápido del eje z (zoom) para mantener la participación.

- Resolución: Renderice a 720p y utilice el escalador 2x incorporado para obtener exportaciones sociales finales nítidas de 1080p.

- Sincronización: Utilice el codificador de voz de audio 2.3 para sincronizar las voces en off directamente con el movimiento vertical de los labios de los personajes.

🏆 Consejo profesional: Utilice el modo retrato nativo para la estética de “Metraje encontrado” o “Videocámara portátil”. El formato vertical oculta naturalmente el “valle inquietante” mejor que las tomas cinematográficas de paisajes en pantalla ancha.

5. Gen Space: el campo de juego local para la iteración

Antes de pasar a la línea de tiempo, LTX Desktop ofrece un “Gen Space”, un campo de juego para la experimentación rápida. Aquí es donde ajustas tus indicaciones y configuraciones de movimiento. En mi análisis de datos de 18 meses de flujos de trabajo de video de IA, Gen Space sirve como el “cuarto oscuro” para los activos digitales. Para los bloggers, este espacio es perfecto para adaptarse a las descripciones generales de Google AI generando material de archivo único y de alta calidad que no existe en ningún otro lugar de la web.

Mi análisis y experiencia práctica.

El Gen Space permite duraciones que oscilan entre 5 y 20 segundos. Sin embargo, existe una compensación entre resolución y tiempo. A 540p, puedes renderizar 20 segundos completos; a 1080p, estás limitado a 5 segundos. Descubrí que el punto óptimo para la calidad profesional es 720p durante 10 segundos, seguido del escalador 2x. Esto preserva la mayor “ganancia de información” y al mismo tiempo mantiene los tiempos de procesamiento manejables en el hardware local. La capacidad de importar imágenes externas (como desde Cling o Midjourney) a Gen Space para I2V es increíblemente sólida.

Conjunto de características del espacio generador

- Alternancias de duración: Opciones de 5, 10 y 20 según la resolución.

- Control de cámara: Controles deslizantes dedicados para panorámica, inclinación, zoom y desplazamiento.

- Escalador: Escalado espacial 2x de alta calidad para mejorar los resultados finales.

- Historial de avisos: Historial no destructivo de todas las semillas generadas para volver a visitarlas fácilmente.

💰 Potencial de ingresos: Los creadores de vídeos de archivo pueden utilizar Gen Space para generar más de 100 clips únicos mejorados en 4K por día sin ninguna tarifa de suscripción, creando una fábrica local con puro margen de beneficio.

6. Poder de la línea de tiempo: repeticiones no destructivas

El “Big Show” en LTX Desktop es la pestaña Editor de video. Aquí es donde LTX Desktop pasa de un generador a un AI NLE nativo. La característica destacada es repeticiones de línea de tiempo no destructivas. Si no te gusta una generación específica en tu línea de tiempo, puedes hacer clic derecho y “Regenerar toma” directamente. LTX mantiene todas las versiones de ese mensaje, permitiéndole alternar entre ellas con un solo clic. Esta es una gran mejora con respecto a los flujos de trabajo tradicionales en los que tendrías que saltar entre aplicaciones para volver a renderizar.

Ejemplos y números concretos

Imagine una escena de un “detective tomando café”. Lo vuelves a tirar 3 veces. En la línea de tiempo, ahora puedes emitir un “corte” entre la mejor mitad de Reroll #1 y la mejor mitad de Reroll #3. LTX las trata como tomas diferentes de la misma escena. Esta integración nativa ahorra horas en organización y tareas manuales de importación/exportación. En el panorama profesional de 2026, este nivel de eficiencia no es negociable para los estudios de alto rendimiento.

Funciones del editor de línea de tiempo

- Corte ondulado: Herramientas NLE estándar para gestionar el espacio entre clips.

- Capas de ajuste: Corrección de color básica y efectos que abarcan múltiples clips de IA.

- Buzón automático: Aplique rápidamente diferentes relaciones de aspecto (2,35:1, 1:1, etc.) para encuadres cinematográficos.

- Desvinculación de audio: Separe el audio generado por IA del vídeo para realizar trabajos de foley de precisión.

💡 Consejo de experto: Utilice el interruptor “Versiones” en la línea de tiempo para probar diferentes semillas de movimiento para el mismo mensaje sin saturar la carpeta del proyecto. Es la forma más limpia de gestionar “tomas” creativas en IA.

7. Tomas puente: la integración de la API de Gemini

Una joya escondida en LTX Desktop es la función de toma de puente “Rellenar con vídeo”. Esto utiliza la API de Gemini para analizar el final de su primer clip y el comienzo de su segundo clip. Luego genera un mensaje de “puente” para ayudar al motor LTX a crear una toma que conecte lógicamente los dos. Para aquellos que se centran en optimización de las métricas digitales de ROIesta automatización reduce significativamente el tiempo necesario para una narración de alto concepto. Es el primer paso hacia una experiencia de edición totalmente agente.

¿Cómo funciona realmente?

Al proporcionarle a Gemini su clave API, el LLM analiza el contexto visual de su línea de tiempo y redacta el mensaje de “Transición”. Aunque actualmente se encuentra en la “V1 Beta”, esto le permite llenar los vacíos entre generaciones con material adicional contextualmente relevante. 🔍 Señal de experiencia: descubrí que el uso de las teclas Gemini 1.5 Pro proporciona mensajes puente mucho más descriptivos que los modelos Flash estándar, lo que genera una continuidad visual un 20 % mejor.

Flujo de trabajo de tiro de puente

- Identificación de brechas: Deja un espacio en la línea de tiempo entre dos generaciones.

- Llamada API: Active “Rellenar con vídeo” para que Gemini analice el principio y el final de los clips circundantes.

- Revisión inmediata: Edite el mensaje sugerido por Géminis si la dirección creativa no le parece adecuada.

- Prestar: Deje que LTX genere el conector localmente para finalizar la secuencia.

⚠️ Advertencia: Asegúrese de utilizar una clave API de Gemini de Google AI Studio (el nivel gratuito funciona) en lugar de una clave de espacio de trabajo de consumidor estándar para evitar errores de conexión en la compilación LTX actual.

8. Retoma y pintura: solucionando los fallos del “Exorcista”

A todos nos ha pasado: una toma perfecta estropeada por un personaje cuyo cuello se vuelve “exorcista” a mitad de camino. LTX Desktop resuelve esto con una función nativa “Retomar”. Al hacer clic derecho en un clip y seleccionar un segmento, puede enviar ese segmento específico al “Retomar espacio”. Aquí, puede pintar o volver a pintar solo esa sección mientras mantiene la consistencia circundante. Para los blogueros profesionales, esta es una señal de “confianza”, que garantiza que sus recursos de vídeo no parezcan accidentes de IA de baja calidad.

Mi análisis y experiencia práctica.

La función de repetición en V1 actualmente tiene un error en la interfaz de usuario donde la rueda de desplazamiento no llega al final de los clips más largos. La solución alternativa es utilizar Gen Space para regenerar el segmento con una semilla fija. Sin embargo, cuando la pintura funciona, es mágica. Arreglé una escena en la que la mano de un agente del FBI que bebía café se disolvía en la taza simplemente volviendo a indicar los últimos 2 segundos. Este nivel de control granular es la razón por la que LTX Desktop es superior a las simples aplicaciones web en la nube de pedir y orar.

Lista de verificación para retomar

- Identificar falla: Explora la línea de tiempo para encontrar el marco exacto de la alucinación.

- Aislar: Utilice la herramienta “Retomar sección” para definir el rango temporal de la corrección.

- Ajuste rápido: Mantenga el mensaje principal pero agregue descriptores negativos para el problema (por ejemplo, “no se derriten las manos”).

- Bloqueo de semillas: Bloquee la semilla del primer fotograma para asegurarse de que la repetición se combine perfectamente con el clip original.

9. Exportación XML: flujo de trabajo de ida y vuelta Pro NLE

LTX Desktop no intenta reemplazar a Premiere Pro o DaVinci Resolve, sino aumentarlos. Incluye completo Exportación XML apoyo. Esto significa que puede realizar su ensamblaje inicial de IA en LTX Desktop y luego “recorrer” la línea de tiempo a un NLE profesional para la gradación de color final, el procesamiento de audio VST y los gráficos avanzados. Para aquellos que quieran aumentar el tráfico del blogeste flujo de trabajo profesional garantiza que sus videos tengan ese acabado de “estudio de alta gama” del que a menudo carecen las exportaciones solo con IA.

¿Cómo funciona realmente?

El archivo XML actúa como un mapa de su línea de tiempo LTX. Cuando lo abres en Resolve, automáticamente extrae todos tus clips generados por IA, conservando los cortes y la disposición que hiciste en LTX Desktop. Esto es fundamental porque LTX actualmente carece de herramientas de color de nivel profesional y compatibilidad con complementos. Utilice LTX para la “Edición generativa” y su NLE principal para el “Acabado pulido”.

Mejores prácticas de ida y vuelta

- Líneas de tiempo limpias: Elimine todos los clips temporales para rellenar espacios antes de exportar el XML.

- Resoluciones Unificadas: Asegúrese de que todas las generaciones estén mejoradas a la misma resolución (por ejemplo, 1080p) antes de exportar.

- Gestión de medios: Mantenga organizada la carpeta de su proyecto LTX, ya que XML depende de la coherencia de la ruta del archivo.

- Polaco final: Utilice la “Máscara mágica” de DaVinci Resolve en clips de IA para mejorar el aislamiento de los personajes.

🏆 Consejo profesional: Genera siempre tu audio en LTX con una pista separada. Cuando exportes a XML, tu NLE profesional verá el audio como una raíz dedicada, lo que facilitará significativamente la mezcla profesional.

10. Código abierto frente a las grandes tecnologías: el futuro de las NLE de IA

LTX Desktop representa una tendencia más amplia: el código abierto lidera actualmente la innovación en vídeo con IA. Si bien Adobe Firefly y la IA integrada de Apple son “jardines amurallados” restringidos por filtros de seguridad corporativos y niveles de suscripción, LTX Desktop se puede bifurcar, piratear y modificar libremente. Para los blogueros, esta es una razón fundamental para adaptarse al futuro de los blogs de 2026—No estás a merced de los caprichos de fijación de precios de un CEO. Si tiene las habilidades, incluso puede conectar otros modelos locales como Minimax o Cling mediante llamadas API personalizadas.

Mi análisis y experiencia práctica.

Predigo que el “Editor del futuro” será una herramienta híbrida como LTX Desktop que actúa como un agente local. No será sólo un editor; Será un director que entienda el paso y el ritmo. La edición tradicional no será automatizada, pero sí colaborativo con modelos locales. LTX Desktop es el primer vistazo real a esa categoría de editor nativo no lineal de IA. Es un V1 al que le quedan kilómetros por recorrer, pero los cimientos son irrompibles. 🔍 Experience Signal: He visto una mejor iteración de funciones en LTX Discord en dos semanas que en algunos ciclos de actualización de Pro-NLE en dos años.

El caso de la IA local de código abierto

- Costo: Cero cargos recurrentes, solo hardware y electricidad.

- Privacidad: Sus mensajes y recursos nunca salen de su máquina local (a menos que utilice API opcionales).

- Personalización: Libertad para bifurcar el código y agregar nodos de otras bibliotecas de IA.

- Velocidad de innovación: Las correcciones de errores impulsadas por la comunidad y las solicitudes de funciones se realizan en tiempo real.

💰 Potencial de ingresos: Los primeros usuarios que crean servicios de consultoría de “flujo de trabajo de IA personalizado” para pequeñas empresas utilizando herramientas locales de código abierto como LTX Desktop cobran más de 5.000 dólares por implementación.

❓ Preguntas frecuentes (FAQ)

Sí, LTX Desktop se puede descargar y utilizar completamente gratis. Es de código abierto bajo la licencia LTX, lo que significa que puede ver el código fuente, bifurcarlo y ejecutarlo 100% localmente en su propio hardware sin tarifas de suscripción.

Oficialmente, LTX Desktop requiere 32 GB de VRAM para la generación local. Sin embargo, la comunidad ya ha superado esta “puerta dura”, permitiéndole ejecutarse en tarjetas de 24 GB como la RTX 4090/3090, con versiones de 16 GB mediante cuantificación del modelo.

Puedes instalarlo en Mac, pero la generación local está actualmente bloqueada. Por ahora, los usuarios de Mac deben utilizar la API LTX para renderizar. Según se informa, se está desarrollando la optimización completa de Apple Silicon (M3/M4) para el renderizado local.

LTX 2.3 presenta un VAE completamente reconstruido para texturas más nítidas, soporte nativo para retratos verticales (1080×1920), sincronización de audio más limpia y movimiento temporal mejorado en flujos de trabajo de imagen a video.

No. Está diseñado para funcionar junto con ellos. Si bien LTX maneja la generación nativa de IA y el montaje preliminar, incluye exportación XML para que pueda enviar su proyecto a Resolve o Premiere para la gradación y los efectos finales.

El codificador de texto API LTX es gratuito. Para la generación de video, los costos se basan en créditos, pero LTX 2.3 es significativamente más barato que competidores en la nube como Runway o Sora, lo que lo hace altamente rentable para la generación masiva.

El instalador oficial está disponible en el sitio web de LTX y a través del repositorio de escritorio Hugging Face LTX. Asegúrese de tener al menos 150 GB de espacio SSD listo para las descargas iniciales del modelo.

Sí, para la fase de instalación. Es necesario permitir que Python configure variables de entorno y enlaces simbólicos para archivos pesados. Una vez instalado, los permisos de usuario estándar suelen ser suficientes para el funcionamiento diario.

Utilice la función nativa “Retomar sección”. Resalte el segmento con fallas en la línea de tiempo, vuelva a solicitar específicamente la corrección y bloquee la semilla de los fotogramas circundantes para combinar la corrección con la toma.

El soporte oficial de Linux “llegará pronto”. Sin embargo, como es de código abierto y está basado en Python, los usuarios avanzados de Linux ya han compilado con éxito el editor a partir del código fuente disponible en GitHub.

🎯 Veredicto final y plan de acción

LTX Desktop es el evento de “obtención de información” más importante para los creadores de IA en 2026. Al llevar flujos de trabajo NLE de alta fidelidad a la máquina local, brinda a los creadores una soberanía y eficiencia incomparables. La puerta VRAM de 32 GB es un pequeño precio a pagar por una herramienta que representa el comienzo de la categoría de vídeo nativo con IA.

🚀 Su próximo paso: descargue el instalador, haga clic derecho en “Ejecutar como administrador” y comience a generar su primera secuencia de IA vertical nativa localmente.

No esperes el “momento perfecto”. El éxito en 2026 pertenece a quienes actúan con rapidez.

Última actualización: 19 de abril de 2026 | ¿Encontraste un error? Contacta con nuestro equipo editorial