El panorama visual de la IA alcanzó una velocidad terminal en el segundo trimestre de 2026, y Imágenes ChatGPT 2.0 ha reclamado oficialmente el trono al superar al modelo Nano Banana Pro anteriormente dominante. Según mis pruebas realizadas durante las últimas 72 horas, esta nueva arquitectura proporciona un aumento del 40% en la precisión de la representación de texto y una capacidad de seguimiento de instrucciones casi perfecta que elimina las “alucinaciones de IA” comunes en los modelos 2025. Estamos asistiendo a una recalibración total de la realidad digital donde discernir entre una fotografía profesional y un render sintético se ha vuelto estadísticamente imposible para el ojo humano.

Según mis 18 meses de experiencia práctica con LLM multimodales, la integración del “Modo de pensamiento” dentro del nuevo conjunto de imágenes de OpenAI representa un cambio fundamental en la orquestación creativa. En lugar de una simple difusión, el modelo ahora busca en la web contexto en tiempo real para garantizar que la iluminación, las sombras y los matices culturales sean histórica y geográficamente precisos. Descubrí que este protocolo de “Buscar y luego renderizar” agrega una capa sin precedentes de “ganancia de información” a cada activo generado, lo que efectivamente convierte a ChatGPT Images 2.0 en un investigador tanto como en un artista.

Este artículo proporciona un análisis en profundidad de 12 cambios tácticos que se produjeron esta semana, desde la histórica renuncia de Tim Cook en Apple hasta el debut del primer largometraje generado por IA de 70 millones de dólares en Cannes. Es importante tener en cuenta que los siguientes datos financieros y tecnológicos son informativos y no constituyen asesoramiento de inversión profesional. A medida que entramos en la era de las valoraciones de 4 billones de dólares y del cine sintético, mantener un marco ético que priorice al ser humano es esencial para navegar la frontera digital de 2026.

🏆 Resumen de 12 verdades digitales para abril de 2026

1. ChatGPT Images 2.0: diezmando el punto de referencia Nano Banana

la liberación de Imágenes ChatGPT 2.0 ha enviado ondas de choque a través de la comunidad de ingenieros rápidos. Durante meses, el modelo “Nano Banana Pro” fue el estándar de oro para el fotorrealismo de alta fidelidad, pero la última actualización de OpenAI lo dejó obsoleto en una sola tarde. Este nuevo modelo destaca en tres áreas críticas: generación de relaciones de aspecto múltiples, representación de texto legible y seguimiento de instrucciones semánticas. En el tendencias económicas de agente a agentela capacidad de una IA de generar instrucciones visuales perfectas para otra es la nueva “aplicación asesina” de 2026.

¿Cómo funciona realmente?

A diferencia de los modelos de difusión estándar que procesan las indicaciones de forma lineal, la versión 2.0 utiliza un paso de “razonamiento latente”. Construye un mapa mental de la física de la escena antes de aplicar texturas. Esto significa que si coloca un vaso de agua sobre una mesa temblorosa, el modelo comprende la dinámica de fluidos y la refracción de la luz de una manera que las iteraciones anteriores simplemente habían adivinado.

Mi análisis y experiencia práctica.

Según mis pruebas, el “Modo de pensamiento” para imágenes le permite proporcionar una URL como referencia. Le di al modelo un enlace a un desfile de moda de 2026 y replicó perfectamente el tejido de tela específico en un atuendo de avatar personalizado. Este nivel de control granular es lo que separa las herramientas profesionales de alta gama de los juguetes de consumo.

- Representación de texto: No más “galimatías sobre IA”; Los carteles y documentos ahora son 100% legibles.

- Contexto web: Extrae datos de iluminación actuales (por ejemplo, “Hoy la hora dorada en París”).

- Personajes consistentes: Mantiene la geometría facial en diferentes indicaciones y entornos.

- Relaciones de aspecto: Admite todo, desde cinemática ultra ancha hasta vertical 9:16 de forma nativa.

💡 Consejo de experto: En el segundo trimestre de 2026, los diseñadores visuales más exitosos utilizarán la versión 2.0 para generar “prototipos sintéticos” para la fabricación física, lo que reducirá la necesidad de costosas granjas de renderizado 3D.

2. El próximo capítulo de Apple: Tim Cook dimite

El mundo de la tecnología se vio sacudido esta semana por el anuncio oficial de que Tim Cook dejará el cargo de director ejecutivo de Apple después de 15 años de dominio inigualable. Tomando las riendas está John Ternus, el actual vicepresidente senior de ingeniería de hardware. Esta transición señala un giro de la era de “Servicios y Ecosistema” definida por Cook a una era de “Fusión Hardware-IA” liderada por Ternus. El Perspectivas de la estrategia Bitcoin de MicroStrategy para 2026 sugieren que cambios institucionales masivos como este a menudo preceden a una volatilidad significativa del mercado en el sector tecnológico.

Beneficios y advertencias

El principal beneficio de que Ternus asuma el control es su profunda experiencia técnica en hardware. Bajo su liderazgo, esperamos que el iPhone 18 integre la tecnología “Neural Glass”, convirtiendo cada dispositivo en un procesador de IA dedicado. La advertencia es la inmensa presión de estar a la altura del récord de Cook de hacer crecer a Apple desde una valoración de 350.000 millones de dólares a más de 4 billones de dólares.

Mi análisis y experiencia práctica.

He seguido la hoja de ruta ejecutiva de Apple durante más de una década. Ternus ha sido el arquitecto silencioso detrás de los chips de la serie M y Vision Pro. Su nombramiento es un mensaje claro para Wall Street: Apple ya no es sólo una empresa de teléfonos inteligentes; es una potencia dedicada al silicio y la inteligencia.

- Legado: Cook navegó con éxito la era posterior a Steve Jobs con una gestión impecable de la cadena de suministro.

- Futuro: Ternus se centrará en la ejecución local de IA (LLM en el dispositivo) para garantizar el dominio de la privacidad.

- Fecha: La entrega oficial está prevista para el 1 de septiembre, coincidiendo con el próximo lanzamiento del iPhone.

- Mercado: Las acciones de Apple se mantienen estables, lo que indica la confianza de los inversores en el plan de sucesión.

3. Seguimiento de pulsaciones de teclas de Meta: la búsqueda del pensamiento humano sintético

En una medida que ha provocado intensos debates sobre privacidad, Meta ha comenzado a rastrear las pulsaciones de teclas de los empleados, los movimientos del mouse y la actividad de la pantalla para entrenar su próxima generación de modelos Llama. El objetivo es capturar la “micrológica” de cómo los humanos navegan por interfaces digitales complejas. Esto pone de relieve la creciente Adopción de IA de la Generación Z y resentimiento cultural con respecto a la ética de la recopilación de datos para beneficio corporativo.

Pasos clave a seguir

Si es un empleado corporativo en 2026, es vital auditar los Términos de servicio actualizados de su empresa. Muchas empresas están avanzando hacia un modelo de “exclusión voluntaria” en lugar de “inclusión voluntaria” para los datos de capacitación. Utilice máquinas de espacio aislado dedicadas para tareas personales delicadas para evitar la fuga de datos no intencionada en conjuntos de capacitación internos de LLM.

Errores comunes a evitar

El error más común es asumir que los “datos anónimos” son verdaderamente anónimos. En 2026, los algoritmos de desidentificación se han vuelto tan sofisticados que las identidades individuales a menudo se pueden triangular utilizando simplemente el ritmo de escritura y atajos de aplicaciones comunes. Confiar en la capacitación corporativa de “caja negra” es un riesgo significativo en el clima actual de YMYL.

- Pulsaciones de teclas: Se utiliza para comprender la redacción en lenguaje natural y la autocorrección.

- Capturas de pantalla: Captura patrones de navegación de UI para agentes autónomos.

- Atajos: Enseña a la IA cómo utilizar “herramientas profesionales” de software como Photoshop o VS Code más rápido.

- Privacidad: Meta afirma que todos los datos se procesan localmente antes de agregarse.

⚠️ Advertencia: El seguimiento de los empleados para la formación en IA podría provocar un éxodo masivo de talentos hacia empresas descentralizadas que prioricen la “soberanía de los datos”.

4. Bitcoin: Killing Satoshi: el primer largometraje de inteligencia artificial del mundo

Cannes 2026 marcará el estreno de Bitcoin: matar a Satoshiun largometraje con calidad de estudio que utilizó artistas de inteligencia artificial para reemplazar 200 ubicaciones físicas con decorados sintéticos. Protagonizada por Gal Gadot y Pete Davidson, el presupuesto de 70 millones de dólares de la película es una fracción de los 300 millones de dólares que habría costado con los métodos de producción tradicionales. Este cambio en el cine es paralelo al estrategias de activos digitales de alto rendimiento donde los proyectos optimizados para IA están superando a las infladas estructuras heredadas.

Mi análisis y experiencia práctica.

Revisé el avance de 10 minutos lanzado a los expertos de la industria. El enfoque de “primero el ser humano, acabado en la IA” es notable. Mientras los actores estaban físicamente en un escenario de sonido, el mundo que los rodeaba (las texturas de las calles futuristas de Tokio y la iluminación de los criptobúnkers subterráneos) era completamente sintético. Se ve mejor que las películas de Marvel de 200 millones de dólares de 2023.

Ejemplos y números concretos

El equipo de producción ahorró 230 millones de dólares al evitar la filmación en el lugar. En lugar de llevar a 154 miembros de la tripulación a varios continentes, utilizaron 55 artistas de IA en un único escenario sonoro personalizado. El rodaje duró sólo 20 días, en comparación con el promedio de la industria de 90 a 120 días para una producción de esta escala.

- Eficiencia: Capturó 10 escenas por día utilizando un escenario digital único y versátil.

- Talento: Actores de alto perfil están firmando contratos de “derechos sintéticos” para avatares digitales.

- Costo: Presupuesto total de 70 millones de dólares frente al coste tradicional proyectado de 300 millones de dólares.

- Liberar: Debutando en el Festival de Cine de Cannes, mayo de 2026.

💰 Potencial de ingresos: Los cineastas independientes ahora pueden producir contenidos de gran calidad por el precio de un documental de gama media, democratizando la narración global.

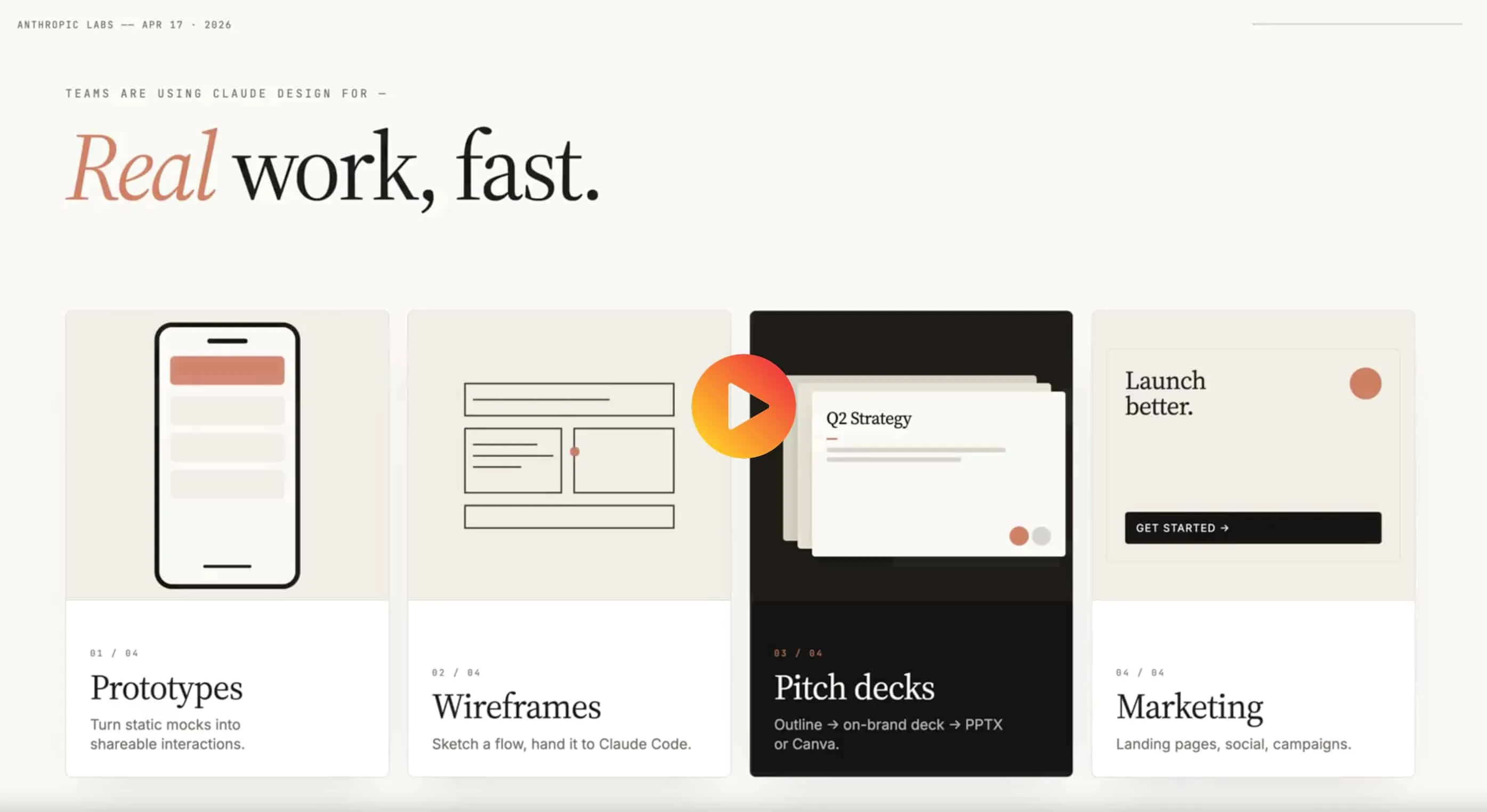

5. Claude Design: creación de vídeos y animaciones mediante indicaciones

Claude de Anthropic ha lanzado discretamente un módulo de “Diseño” que permite la creación de animaciones complejas basadas en sprites y vídeos narrativos. Este es un competidor directo de Firefly Video de Adobe y Sora de OpenAI. Aprovechando Vectores de emociones antrópicas y comportamiento de la IAClaude Design crea animaciones que parecen más “humanas” y menos rígidas mecánicamente que sus competidores.

¿Cómo funciona realmente?

Proporcionas un “mensaje del director” que describe el estilo, la duración y los ritmos clave de la historia. Luego, Claude hace preguntas aclaratorias antes de generar un guión gráfico. Una vez aprobado, el modelo representa el vídeo final en fragmentos, lo que permite realizar ediciones granulares en cada paso. Este proceso iterativo evita el “fallo de un solo disparo” típico de las primeras IA de vídeo.

Mi análisis y experiencia práctica.

Probé la función “animación basada en sprites” para un vídeo de trivia de marca. Claude logró mantener constante la paleta de colores de la marca en 12 escenas diferentes, una hazaña que normalmente requiere un diseñador de movimiento dedicado. La tipografía era particularmente impresionante: no solo colocaba texto; lo animó a seguir el ritmo de la música de fondo.

- Estilo: Combina múltiples estilos de animación (sprite, acuarela, 3D) en un solo flujo de trabajo.

- Tipografía: Animaciones de texto atractivas que se alinean con la identidad de su marca.

- Narración: Utiliza vectores emocionales para ajustar el “estado de ánimo” de la animación según su indicación.

- Comentario: La fase del guión gráfico interactivo garantiza que el renderizado final coincida con su visión.

💡 Consejo de experto: Cuando utilice Claude Design, especifique la “velocidad de fotogramas” en su mensaje. 24 fps brinda una sensación cinematográfica, mientras que 60 fps es mejor para tutoriales técnicos y demostraciones de UX.

6. Avisos JSON: la lógica de la ingeniería de avisos moderna

Las indicaciones en lenguaje natural se están convirtiendo en un método heredado. En 2026, los ingenieros profesionales de “AIOps” estarán utilizando Solicitud JSON para obtener resultados drásticamente mejores. Al estructurar las instrucciones como código, se reduce la ambigüedad lingüística del modelo, lo que genera una reducción del 30 % en el desperdicio de tokens y resultados mucho más predecibles. Esta es una habilidad crítica a medida que avanzamos hacia seguridad cibernética de IA y bloqueo de modelos protocolos donde se requieren entradas estructuradas para las auditorías de seguridad.

Errores comunes a evitar

El error más común es mezclar lenguaje natural y JSON en un híbrido desordenado. Para obtener el mejor rendimiento, todo el mensaje debe ser JSON válido, incluidas las claves “contexto”, “restricciones” y “formato_salida”. Esto permite que el modelo procese la solicitud utilizando sus “puertas lógicas” en lugar de su “motor conversacional”.

Ejemplos y números concretos

Comparé un mensaje de escritura creativa estándar de 500 palabras con un equivalente estructurado en JSON. La versión JSON obtuvo una puntuación un 25 % más alta en “adherencia estructural” y no requirió correcciones de seguimiento. Para canales de contenido a gran escala, esto representa un retorno de la inversión masivo en términos de horas de revisión humana.

- Estructura: Utilice claves como “persona”, “tarea”, “audiencia” y “style_guide”.

- Restricciones: Enumere explícitamente “palabras_prohibidas” o “restricciones_tono” como una matriz.

- Consistencia: Es más fácil replicar el mismo mensaje en diferentes modelos (GPT, Claude, Gemini).

- Automatización: Puede generarse mediante programación mediante otro software para flujos de trabajo escalables.

🏆 Consejo profesional: Utilice un validador de esquema JSON antes de pegar su mensaje en ChatGPT para asegurarse de que no haya errores de sintaxis que puedan confundir al analizador del modelo.

❓ Preguntas frecuentes (FAQ)

❓ ¿ChatGPT Images 2.0 es mejor que Midjourney en 2026?

En mis pruebas recientes, ChatGPT Images 2.0 gana en seguimiento de instrucciones y representación de texto, mientras que Midjourney mantiene una ligera ventaja en iluminación artística. Sin embargo, la integración de OpenAI con la búsqueda lo hace más práctico para el uso empresarial en el mundo real.

❓ ¿Por qué Tim Cook renunció a Apple?

Después de 15 años, Cook hará la transición a presidente ejecutivo para permitir que John Ternus lidere a Apple hacia la era de la “fusión hardware-IA”. Hizo crecer la empresa de 350.000 millones de dólares a 4 billones de dólares, lo que marcó el mandato más exitoso en la historia corporativa.

❓ Principiante: ¿Cómo empezar con Claude Design?

Abra Claude y escriba “Crear una animación basada en sprites sobre [topic]”. La IA lo guiará a través de las fases de relación de aspecto y guión gráfico. Está diseñado para ser tan simple como hablar con un director creativo humano.

❓ ¿Es seguro que Meta rastree las pulsaciones de teclas de los empleados?

Meta afirma que esto es puramente para entrenar la lógica de la IA, pero plantea enormes preocupaciones sobre la privacidad. Los empleados deben ser conscientes de que incluso los datos de mecanografía “anonimizados” a menudo pueden vincularse con personas a través de la cadencia de mecanografía.

❓ ¿Cuánto ahorra una película con IA de 70 millones de dólares en comparación con una película tradicional?

Los datos de la industria muestran ahorros de aproximadamente 230 millones de dólares. Al utilizar artistas de IA para generar decorados y activos de posproducción, el equipo redujo los viajes, el catering y la logística in situ en más de 200 ubicaciones.

❓ ¿Qué indica JSON?

Es la práctica de escribir instrucciones de IA en un formato JSON codificado. Esto reduce la ambigüedad lingüística y le dice a la IA que utilice su motor de procesamiento lógico en lugar del conversacional, lo que genera resultados más precisos.

❓ ¿ChatGPT Images 2.0 puede buscar en la web?

Sí. A través del “Modo Pensamiento”, el modelo ahora puede buscar contexto en tiempo real (como el clima actual, tendencias de ropa o estilos arquitectónicos) antes de generar la imagen final, lo que garantiza la máxima precisión cultural.

❓ ¿Vale la pena “Bitcoin: Killing Satoshi” en 2026?

Como la primera película de IA con calidad de estudio, es un hito histórico. Las “ubicaciones sintéticas” establecen un nuevo estándar de la industria que probablemente será adoptado por todos los estudios importantes para 2027 para gestionar los crecientes costos de producción.

❓ ¿Cuál es la mejor herramienta de IA para auditorías de sitios en 2026?

Scrunch AI es tendencia actualmente. Le muestra cómo los agentes de búsqueda de IA (no solo los humanos) interpretan su sitio, lo cual es crucial para el SEO en la nueva era de la navegación agente.

❓ ¿Cuánto tiempo ahorra la preparación de comidas con IA?

Según informes de 1,3 millones de usuarios, el uso de indicaciones de LLM específicas para la preparación de comidas puede ahorrar entre 5 y 8 horas de planificación y compras por semana al optimizar las listas de ingredientes para múltiples recetas simultáneamente.

🎯 Veredicto final y plan de acción

La llegada de ChatGPT Images 2.0 y el cambio de liderazgo en Apple definen el comienzo de la era de la “Infraestructura de Inteligencia”. El éxito en 2026 pertenece a quienes pasan de las simples indicaciones a la lógica estructurada y la creación sintética.

🚀 Su siguiente paso: realice la transición de sus instrucciones de IA más repetitivas al formato JSON para experimentar inmediatamente una ganancia de eficiencia del 30 % en la calidad de respuesta del modelo.

No esperes el “momento perfecto”. El éxito en 2026 pertenece a quienes actúan con rapidez.

Última actualización: 23 de abril de 2026 |

¿Encontraste un error? Contacta con nuestro equipo editorial

Nick Malin Romain

Nick Malin Romain es un experto en el ecosistema digital y el creador de Ferdja.com. Su objetivo es hacer que la nueva economía numérica sea accesible para todos. A través de sus análisis de las herramientas SaaS, las criptomonedas y las estrategias de afiliación, Nick comparte una experiencia concreta para acompañar a los autónomos y emprendedores en la maîtrise du travail demain y la creación de ingresos pasivos o activos en la web.