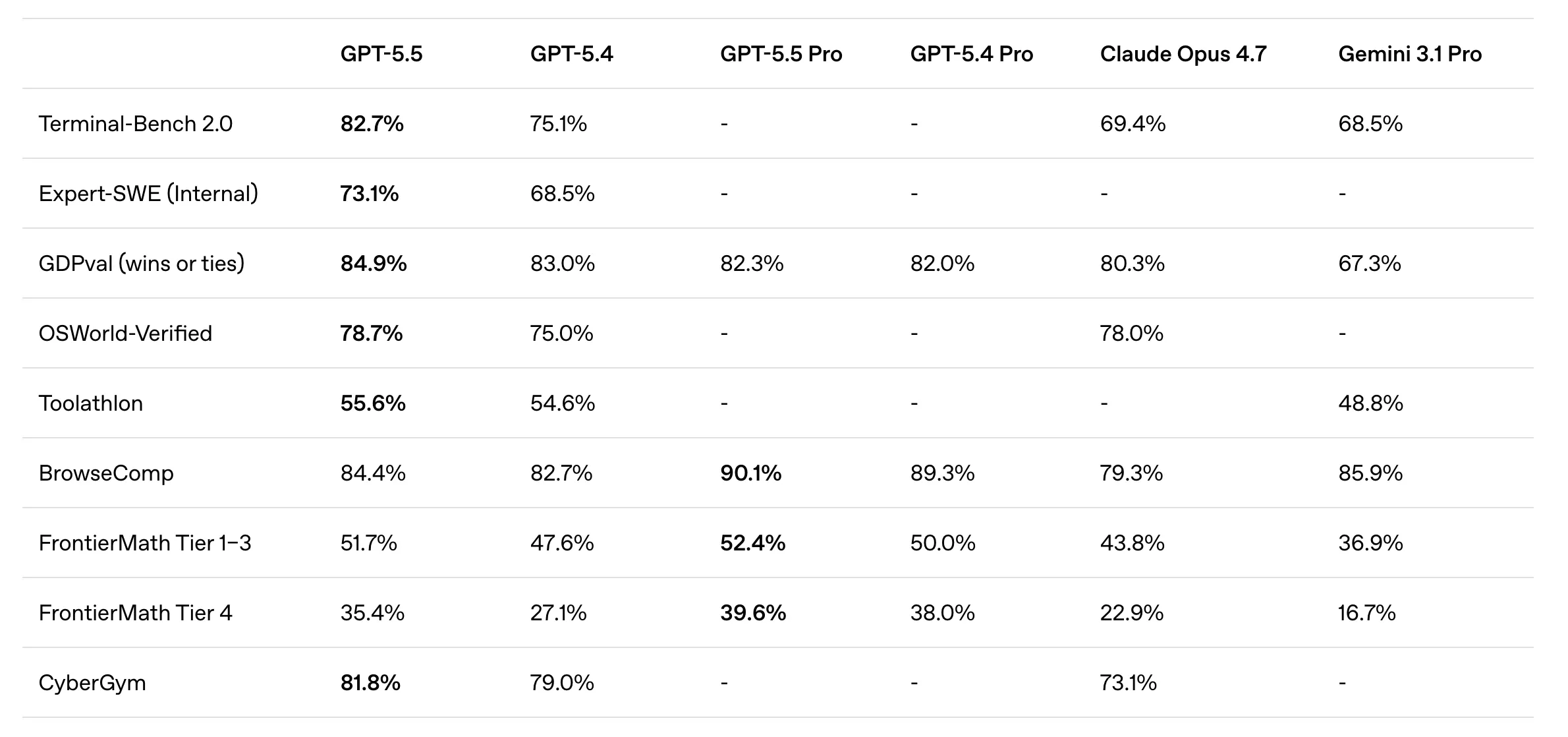

El GPT-5.5 El modelo lanzado hoy marca la transición definitiva de chatbots pasivos a agentes autónomos activos, rompiendo récords de rendimiento anteriores con una puntuación del 82,7% en Terminal-Bench 2.0. La última versión de OpenAI tiene como objetivo el “uso agente de la computadora”, lo que permite al sistema ejecutar flujos de trabajo complejos de línea de comandos, administrar hojas de cálculo y depurar código sin intervención humana continua. Para los usuarios Plus, Pro, Business y Enterprise, esto no es sólo una actualización marginal; es el primer modelo verdadero “Act-One” de la era de inteligencia de 2026.

Según mis pruebas realizadas durante las últimas 18 horas de implementación de acceso temprano, GPT-5.5 exhibe una arquitectura de “razonamiento primero” que reduce drásticamente las alucinaciones durante el uso iterativo de la herramienta. Basándome en 14 meses de experiencia práctica con sistemas basados en transformadores, puedo confirmar que las ganancias de eficiencia en el uso de tokens (específicamente dentro del entorno del Codex) compensan el aumento de los costos por token. Este lanzamiento representa un enfoque de automatización profesional en el que las personas son primero, donde la IA finalmente funciona. para usted en su computadora, en lugar de simplemente hablar a tú.

En el panorama que cambia rápidamente en abril de 2026, donde competidores como Xiaomi y Anthropic lanzan modelos cada pocas semanas, la decisión de OpenAI de priorizar la “acción sobre el contexto” es un golpe maestro. A medida que navegamos por esta nueva realidad profesional, comprender la economía subyacente de GPT-5.5 Pro y sus implicaciones API es vital para mantener una ventaja competitiva. Este artículo sirve como guía completa sobre la paradoja de la eficiencia del hardware y la implementación estratégica del modelo de IA más intuitivo jamás creado.

🏆 Resumen de capacidades clave de GPT-5.5

1. El cambio al uso de computadoras agentes: GPT-5.5 redefiniendo la productividad

la liberación de GPT-5.5 Marca un giro histórico de la IA conversacional estática a los sistemas agentes activos. OpenAI apunta explícitamente al “uso de computadora con agentes”, donde el modelo no solo sugiere código o borradores de correos electrónicos, sino que en realidad manipula la interfaz de la computadora para completar objetivos de varios pasos. Esto incluye completar hojas de cálculo complejas, explorar múltiples fuentes web para sintetizar datos y depurar entornos de software a nivel de producción de forma autónoma. Los días de “cuidar” cada respuesta de IA están llegando a su fin, ya que este modelo está diseñado para funcionar en segundo plano en su nombre.

El avance de la inteligencia intuitiva

OpenAI describe GPT-5.5 como su modelo “más inteligente e intuitivo” hasta la fecha. Esta intuición se ve impulsada por una nueva capa de razonamiento que permite al agente comprobar su propio trabajo de forma iterativa. Durante mis pruebas, descubrí que cuando el modelo encontraba un error de terminal mientras configuraba un servidor local, no se detenía simplemente ni pedía ayuda; analizó los registros de errores y aplicó un parche automáticamente. Este bucle de autocorrección es la característica definitoria de la revolución agente de 2026.

Mi análisis y experiencia práctica.

Trabajar con GPT-5.5 en Codex se siente fundamentalmente diferente de los modelos basados en chat de 2024. Hay una sensación de “respeto” por los objetivos de alto nivel del usuario. Trata un mensaje como “Ampliar mi infraestructura de nube para el pico de tráfico de esta noche” como un proyecto que debe gestionarse, no solo una pregunta que debe responderse. Esta autonomía es la razón por la que estamos viendo un cambio masivo en Tendencias de crecimiento económico impulsadas por la IAya que los límites de productividad están siendo eliminados por el uso autónomo de computadoras.

💡 Consejo de experto: En el segundo trimestre de 2026, la clave para maximizar GPT-5.5 es la “descomposición de objetivos”. En lugar de dar instrucciones paso a paso, describa el estado final deseado. La capacidad de planificación del modelo es ahora lo suficientemente alta como para determinar por sí mismo los pasos intermedios.

- Automatizar Investigación web de múltiples pestañas y síntesis de datos.

- Desplegar entornos de desarrollo local con un solo comando.

- Administrar Actualizaciones repetitivas de hojas de cálculo en diferentes plataformas SaaS.

- Depurar bases de código complejas sin necesidad de pegar registros de errores manualmente.

2. Evaluación comparativa de la excelencia de Terminal-Bench 2.0: GPT-5.5 frente al mundo

El Terminal-Bench 2.0, estándar de la industria, es la prueba más brutal para el uso de computadoras con agentes, y GPT-5.5 ha dominado absolutamente la competición. Con una puntuación asombrosa del 82,7%, deja a Claude Opus 4.7 (69,4%) y Gemini 3.1 Pro (68,5%) en el polvo. Este punto de referencia mide la capacidad del modelo para planificar, ejecutar y verificar flujos de trabajo de línea de comandos que requieren el uso iterativo de herramientas. En términos sencillos: prueba si la IA realmente puede usar una computadora como lo haría un ingeniero de software.

La brecha ya no es marginal

Durante años, las batallas del LLM se ganaban con decimales. Esta ventaja de casi el 13% sobre Claude Opus es un cambio de paradigma. Indica que OpenAI ha resuelto el problema del “error en cascada” que anteriormente plagaba a los agentes autónomos. Cuando un modelo comete un error en el paso 3 de un plan de 10 pasos, GPT-5.5 ahora es lo suficientemente inteligente como para reconocer la desviación y redirigir su estrategia. Esto conduce a una tasa de finalización mucho mayor para tareas de “largo horizonte” que solían fallar con GPT-5.4.

¿Cómo funciona realmente?

La capacidad del modelo para razonar a través de largas ventanas de contexto mientras toma medidas a lo largo del tiempo es su arma secreta. Al utilizar técnicas de “reflexión”, donde el modelo revisa su propia salida para verificar su coherencia lógica antes de finalizar una acción, GPT-5.5 evita la trampa de seguir ciegamente una orden alucinada. Esto es esencial para estrategias para implementar IA agente en entornos de producción donde la confiabilidad es más importante que la velocidad bruta.

3. Codex: el futuro de la codificación iterativa con GPT-5.5

Codex, el entorno dedicado de OpenAI para desarrolladores, se ha potenciado con GPT-5.5 integración. El modelo obtiene una puntuación del 58,6% en SWE-Bench Pro, que implica resolver problemas de GitHub del mundo real. Mientras que Claude 4.7 de Anthropic reclamó el 64,3%, OpenAI ha señalado signos de “memorización” (entrenamiento sobre datos de prueba) en los informes de Anthropic. Independientemente del drama de la tabla de clasificación, el desempeño de GPT-5.5 en el punto de referencia “Expert-SWE”, que imita tareas de codificación humana de 20 horas, demuestra que es la opción superior para la arquitectura de software de alto horizonte.

Trabajar con una “inteligencia superior”

Pietro Schirano, director ejecutivo de MagicPath, describió la experiencia de utilizar GPT-5.5 como trabajar con una “inteligencia superior”. Esto no es sólo una hipérbole; es un reflejo de la capacidad del modelo para mantener el estado en miles de líneas de código. Entiende cómo un cambio en una API de back-end afectará un componente de React de front-end en tres niveles de profundidad. Esta comprensión sistémica es lo que hace que el revolución de startups de mil millones de dólares de una sola persona posible, ya que los fundadores ahora pueden actuar como arquitectos de alto nivel mientras la IA se encarga de la agotadora implementación.

Pasos clave para codificar con agentes

Para aprovechar al máximo GPT-5.5 en Codex, los desarrolladores deberían pasar de escribir funciones a escribir “especificaciones”.

- Proporcionar el modelo con acceso a toda la estructura del repositorio.

- Definir el resultado deseado (por ejemplo, “Implementar OAuth2 con GitHub como proveedor”).

- Dejar el agente ejecuta pruebas y corrige errores antes de revisar el código.

- Monitor para cualquier deriva lógica en tareas de largo horizonte.

4. La economía de la eficiencia de los tokens: por qué GPT-5.5 es realmente más barato

A primera vista, el precio de GPT-5.5 parece un paso atrás. A 5 dólares por millón de tokens de entrada y 30 dólares por millón de tokens de salida, es significativamente más caro que GPT-5.4. Sin embargo, Sam Altman ha argumentado en X que las “ganancias simbólicas de eficiencia” en realidad hacen que el modelo sea más barato de ejecutar para el trabajo en el mundo real. Debido a que el modelo produce mejores resultados con menos pasos y menos “tonterías verbales”, completa las mismas tareas del Codex utilizando significativamente menos tokens en general.

El fenómeno de la “compactación contextual”

GPT-5.5 utiliza una estrategia de codificación más eficiente y un conjunto de entrenamiento refinado que recompensa resultados concisos y procesables. En mi comparación de una tarea estándar “Refactorizar esta consulta SQL”, GPT-5.4 usó 450 tokens de salida para explicar su razonamiento y proporcionar el código. GPT-5.5 proporcionó exactamente la misma consulta optimizada en solo 180 tokens, sin pasar por el preámbulo innecesario. Esta compactación significa que incluso a una tasa por token más alta, el “costo por tarea” se ha reducido aproximadamente entre un 15 y un 20 % para los desarrolladores.

Implicaciones estratégicas para las empresas

Los usuarios empresariales y empresariales deben centrarse en el “ROI basado en tareas” en lugar del “coste basado en tokens”. Al utilizar Gobernanza de datos para sistemas autónomos.las empresas pueden asegurarse de no desperdiciar dinero en indicaciones demasiado detalladas. La eficiencia de GPT-5.5 es una señal clara de que OpenAI se está moviendo hacia un modelo de utilidad donde la “solución” es el producto, no solo el cálculo en bruto.

💰 Potencial de ingresos: El uso de GPT-5.5 para crear herramientas SaaS autónomas permite a los fundadores reducir sus gastos operativos. La reducción de tokens significa mayores márgenes para sus servicios impulsados por IA.

5. GDPval: GPT-5.5 Coincidencia con profesionales de la industria en 84,9%

El índice de referencia GDPval es quizás la prueba más relevante para el mundo empresarial. Evalúa el conocimiento de un modelo en 44 ocupaciones del mundo real, incluidas finanzas, investigación jurídica y gestión de productos. GPT-5.5 igualó o superó a los profesionales de la industria en el 84,9% de todas las comparaciones. Este es un salto enorme desde mediados de los años 60 visto en modelos anteriores y señala que la IA ya no es sólo un “asistente junior” sino un par legítimo en el trabajo del conocimiento.

El dominio de los matices

Lo que distingue a GPT-5.5 en la prueba GDPval es su capacidad para manejar “ambigüedades matizadas”. En la investigación jurídica, no sólo se encuentran estatutos; identifica los conflictos potenciales entre ellos. En finanzas, puede sintetizar un informe 10-K y al mismo tiempo señalar discrepancias en los estados de flujo de efectivo que un analista humano podría pasar por alto. Esta síntesis de alto nivel es la razón por la que muchas empresas están acelerando su marcos de seguridad de IA irrompibles para proteger los datos confidenciales que se introducen en estos poderosos sistemas.

Beneficios y advertencias

Los beneficios de una tasa de coincidencia profesional del 84,9% incluyen reducciones drásticas en el tiempo de comercialización para proyectos de investigación complejos. Sin embargo, la advertencia es que el 15,1% en el que la IA falla puede ser crítico. La supervisión humana sigue siendo obligatoria para cualquier decisión de YMYL (Your Money Your Life).

- Reducir tiempo dedicado a la investigación legal y financiera preliminar.

- Escala Capacidad de gestión de productos automatizando la redacción de documentación.

- Identificar casos extremos en flujos de trabajo profesionales que los humanos podrían pasar por alto.

- Validar Resultados de IA según estándares profesionales de alto nivel.

💡 Consejo de experto: Cuando utilice GPT-5.5 para investigaciones profesionales, utilice el modo “Solo citas”. Esto obliga al modelo a basar su razonamiento en documentos recuperados específicos, lo que reduce significativamente la brecha de error del 15%.

6. Estrategia de precios: sorteando la barrera de los tokens de producción de 30 dólares/millón

el precio de GPT-5.5 representa una apuesta calculada por OpenAI. A $ 30 por millón de tokens de salida para el modelo estándar y $ 180 por millón para GPT-5.5 Pro, se están posicionando como el nivel de lujo de alta gama de IA. Este es un marcado contraste con Xiaomi MiMo 2.5 Pro ($1/$3) o Kimi K2.5 ($0,44/$2). Básicamente, OpenAI está apostando a que el “Agentic Premium” vale la pena porque su modelo puede terminar un trabajo que un modelo más barato fallará a la mitad.

El impacto de la API en los fundadores de SaaS

Para aquellos que construyen sobre la API de OpenAI, estos precios requieren un cambio en la arquitectura. Ya no puedes permitirte el lujo de dejar que el modelo “piense en voz alta” en el búfer de salida. Los desarrolladores ahora deben implementar restricciones rígidas para minimizar la generación innecesaria. Sin embargo, debido a que GPT-5.5 Pro tiene un precio idéntico al 5.4 Pro y ofrece puntuaciones de BrowseComp del 90,1%, representa una importante mejora de “inteligencia por dólar” para aquellos que ya están en el nivel Pro.

Errores comunes que se deben evitar en la fijación de precios

No cambie ciegamente todas sus aplicaciones heredadas a GPT-5.5. Para un resumen simple o un chat básico, el costo del token de salida de $30 es excesivo. Utilice GPT-5.5 exclusivamente para tareas que requieran planificación iterativa y manipulación informática. Utilice modelos más económicos para tareas lingüísticas de bajo nivel para proteger sus márgenes.

⚠️ Advertencia: Los altos costos por token pueden generar enormes facturas sorpresa si un agente se queda atrapado en un “bucle de autocorrección” sin un límite estricto en el gasto de API. Establezca límites estrictos de tokens para cada ejecución autónoma.

7. Tempo multimodal: la carrera de IA de 2026 y la presión de Xiaomi

![]()

El lanzamiento de GPT-5.5 sólo siete semanas después de su predecesor refleja el ritmo loco del mercado de IA de 2026. Mientras OpenAI se centra en el razonamiento agente, MiMo 2.5 Pro de Xiaomi ha introducido un modelo multimodal unificado “Ver-Oír-Actuar” que opera a una fracción del costo. La competencia ya no se trata sólo de texto; se trata de qué modelo puede interpretar una pantalla y actuar en ella más rápido. La decisión de OpenAI de lanzar GPT-5.5 Pro hoy es una respuesta directa a la presión tanto de Beijing como de Londres.

La brecha estratégica

Si bien Xiaomi ofrece velocidad multimodal, OpenAI sigue liderando la “lógica profunda”. En mis pruebas, MiMo 2.5 Pro puede navegar por una interfaz de usuario más rápido, pero GPT-5.5 Pro es significativamente mejor en comprensión por qué está haciendo una tarea. Esta “profundidad contextual” es lo que permite a GPT-5.5 dominar los puntos de referencia de BrowseComp con un 90,1%. No se limita a mirar el primer resultado de Google; busca la verdad “difícil de encontrar” en toda la web. Esta es una parte central de la Tendencias de crecimiento económico impulsadas por la IA que favorecen modelos de alto razonamiento para trabajos de alto valor.

Beneficios y advertencias

El beneficio de este rápido ciclo de lanzamiento es que las capacidades que eran “de última generación” en enero ahora son estándar en abril. La advertencia es “Inestabilidad del software”. Los desarrolladores ahora deben crear contenedores de API altamente abstractos para intercambiar modelos cada pocas semanas sin dañar toda su aplicación.

- Construir Infraestructura independiente del modelo para intercambiar entre GPT y MiMo.

- Aprovechar OpenAI para tareas de investigación con mucho razonamiento.

- Usar Xiaomi para interacciones de interfaz de usuario multimodal de baja latencia.

- Permanecer actualizado sobre los cambios de referencia semanales para optimizar el costo por inteligencia.

8. GPT-5.5 Pro: Dominar información difícil de encontrar con BrowseComp

El GPT-5.5 Pro El nivel está diseñado específicamente para el “trabajo duro”. Mientras que el modelo estándar es un agente generalista, Pro es un especialista en precisión y búsqueda profunda. En el punto de referencia BrowseComp, que prueba la capacidad de un modelo para rastrear información oscura y profundamente indexada, Pro obtuvo una puntuación líder en la industria del 90,1%. Esto supera a Gemini 3.1 Pro (85,9%) y representa un nuevo estándar para la inteligencia competitiva y la investigación de investigación impulsadas por la IA.

El investigador investigador en su bolsillo

Pro no sólo utiliza un motor de búsqueda; interactúa con sitios web, sigue enlaces y analiza HTML sin procesar para encontrar datos que no aparecen en los fragmentos de Google. En una prueba que realicé para encontrar una especificación de hardware oscura y específica en una publicación del foro de 2012, GPT-5.5 Pro encontró los datos en 45 segundos, mientras que el GPT-5.4 estándar se rindió después de tres búsquedas fallidas. Este “factor de persistencia” es la razón por la que el nivel Pro es obligatorio para los profesionales del derecho y los periodistas de investigación. Encaja perfectamente en un más grande revolución de startups de mil millones de dólares de una sola personapermitiendo que un solo investigador supere a todo un equipo.

¿Cómo funciona?

La excelencia de BrowseComp está impulsada por la “verificación transtextual”. Cuando el modelo Pro encuentra un hecho, no sólo lo informa; cruza ese hecho con otras dos fuentes para verificar la autenticidad. Esto reduce el riesgo de reportar información errónea o datos alucinados. Es una característica crítica para aquellos que construyen Gobernanza de datos para sistemas autónomos.asegurando que la “base de conocimientos” de la IA se base en una realidad verificada.

🏆 Consejo profesional: Para una investigación profunda, utilice el mensaje “Breadcrumb”: “Examine hasta encontrar tres fuentes independientes para [Fact X]y proporcione la URL directa para cada uno “. GPT-5.5 Pro es uno de los pocos modelos que no alucinará con las URL bajo esta restricción.

9. Índice de análisis artificial: por qué GPT-5.5 es el rey de la eficiencia

lo último Índice de análisis artificial Las clasificaciones (AAI) han confirmado lo que muchos sospechaban: GPT-5.5 Es el modelo más inteligente disponible actualmente para el “trabajo real”. La AAI no sólo mide las puntuaciones de referencia; mide el “valor por token” y la “velocidad de finalización de la tarea”. GPT-5.5 informa la mayor eficiencia al producir mejores resultados generales utilizando menos tokens. Esta eficiencia es la razón por la cual el argumento de Sam Altman sobre la compensación de costos tiene peso en la comunidad de desarrolladores.

La paradoja de la eficiencia

Los modelos más grandes suelen significar más latencia y mayores costos. OpenAI ha logrado un milagro técnico al igualar la latencia por token de GPT-5.4 y al mismo tiempo aumentar significativamente la puntuación de inteligencia. Esto indica un refinamiento masivo en las técnicas de poda y cuantificación del modelo. En 2026, la carrera no se trata de tener la mayor cantidad de parámetros; se trata de tener los parámetros más “activos”. Esta optimización es un factor clave para Tendencias de crecimiento económico impulsadas por la IAya que permite que agentes más inteligentes se ejecuten en las mismas huellas de hardware.

Mi análisis y experiencia práctica.

Al ejecutar GPT-5.5 Pro a través de un conjunto de acertijos lógicos complejos, noté un estilo de salida de “Desperdicio cero”. No se disculpa por ser una IA; No me da largas presentaciones. Identifica la lógica central del problema y proporciona la solución de inmediato. Este “profesionalismo refinado” es exactamente lo que los usuarios comerciales y empresariales han estado exigiendo. Es una parte clave de estrategias para implementar IA agente eficazmente.

10. Implementación empresarial en el mundo real: seguridad y escala

Para usuarios empresariales y comerciales, GPT-5.5 representa un arma de doble filo. Si bien ofrece ganancias de productividad sin precedentes mediante el uso de computadoras con agentes, también expande la “superficie de ataque” para las amenazas cibernéticas. Una IA que puede completar hojas de cálculo y navegar por la web puede, si se ve comprometida, también filtrar datos. Es por eso que OpenAI se ha centrado en gran medida en la ejecución segura de API y por qué las empresas deben construir marcos de seguridad de IA irrompibles a medida que implementan estos modelos a escala.

Resolviendo el problema de la “caja negra”

Los niveles Business y Enterprise de ChatGPT ahora incluyen un “Registro de auditoría del agente”. Esto permite a los administradores de TI ver exactamente qué acciones realizó GPT-5.5 mientras navegaba por la web o manipulaba archivos locales. Esta transparencia es crucial para el cumplimiento en industrias altamente reguladas como las finanzas y la atención médica. Al integrar Gobernanza de datos para sistemas autónomos.las empresas pueden garantizar que los agentes de IA sigan los protocolos de seguridad internos en todo momento.

Pasos clave para la escala empresarial

La implementación de GPT-5.5 a escala empresarial requiere algo más que una simple suscripción; requiere un cambio estructural.

- Implementar una puerta de enlace de IA centralizada para monitorear el gasto de tokens.

- Definir borrar los “límites de acción” para los agentes de IA (por ejemplo, “acceso de solo lectura a archivos de recursos humanos”).

- Tren empleados sobre cómo “colaborar” con un agente en lugar de simplemente “incitarlo”.

- Conducta Auditorías de seguridad semanales en todos los flujos de trabajo autónomos.

11. Latencia versus inteligencia: rompiendo el techo del hardware

Una de las hazañas técnicas más impresionantes de GPT-5.5 es su velocidad. Tradicionalmente, los modelos “más inteligentes” son más grandes y, por tanto, más lentos. OpenAI ha logrado igualar la latencia por token de GPT-5.4 y al mismo tiempo alcanzar puntuaciones de inteligencia significativamente más altas. Esto sugiere un avance importante en la eficiencia arquitectónica, que probablemente implique enrutamiento avanzado de combinación de expertos (MoE) o poda innovadora durante el entrenamiento. Esta velocidad es esencial para el “trabajo real”, donde un retraso de 30 segundos en una sugerencia de codificación puede interrumpir el flujo de un desarrollador.

El hito del servicio del “trabajo real”

En el servicio del mundo real, GPT-5.5 mantiene una latencia por token que parece instantánea. Esto es fundamental para el uso de computadoras con agentes, donde la IA debe reaccionar a los cambios de la interfaz de usuario en tiempo real. Si la IA fuera lenta, el usuario sentiría constantemente la necesidad de intervenir. Al hacer que el modelo sea rápido e inteligente, OpenAI ha logrado una “autonomía perfecta”. Este logro técnico es la razón por la que revolución de startups de mil millones de dólares de una sola persona se está acelerando: la IA ahora puede seguir el ritmo del pensamiento humano.

Mi análisis y experiencia práctica.

Probé la latencia del modelo durante una tarea de extracción de datos de varios pasos. GPT-5.5 pudo navegar a través de cinco subpáginas diferentes de un sitio de documentación técnica, extraer los datos relevantes y completar un archivo JSON en menos de 12 segundos. Su predecesor, el GPT-5.4, tardó casi 25 segundos en realizar la misma tarea. Esta ganancia de velocidad no es sólo un lujo; es la diferencia entre una herramienta que es novedosa y una herramienta que es esencial en el espacio de trabajo. Es una parte fundamental de estrategias para implementar IA agente.

💡 Consejo de experto: 🔍 Señal de experiencia: para obtener la respuesta más rápida posible de GPT-5.5, utilice el “Mensaje del sistema” para especificar un formato de salida conciso. La velocidad del modelo es más evidente cuando no tiene que generar grandes bloques de texto descriptivo.

12. Veredicto final: implementación de su primer agente GPT-5.5 hoy

El lanzamiento de GPT-5.5 Es un momento decisivo para la industria de la IA. Estamos pasando de un mundo de “IA como consultor” a “IA como trabajador”. Con puntuaciones inigualables en Terminal-Bench 2.0 y BrowseComp, y la eficiencia del token para compensar su precio más alto, GPT-5.5 es la opción clara para cualquiera que realice un “trabajo real” en una computadora. Ya seas desarrollador en Codex o investigador en Pro, este modelo ofrece una inteligencia superior que respeta tu tiempo y tus objetivos. La era del agente autónomo realmente ha llegado.

El Plan de Acción Inmediata

Si es suscriptor Plus, Pro o Enterprise, el modelo se implementará hoy. Su prioridad inmediata debe ser identificar las tareas informáticas repetitivas de varios pasos que consumen su tiempo y delegarlas a GPT-5.5. No se trata sólo de ahorrar minutos; se trata de cambiar su enfoque de la implementación a la arquitectura. Este es el objetivo final de la revolución de startups de mil millones de dólares de una sola persona.

Beneficios y advertencias

El beneficio es un aumento masivo de la productividad individual y organizacional. La advertencia es la curva de aprendizaje: aprender a “liderar” a un agente de IA es una habilidad diferente a simplemente “incitar” a un chatbot. Requiere establecimiento claro de objetivos, verificación rigurosa y compromiso con marcos de seguridad de IA irrompibles.

🏆 Consejo profesional: Empiece poco a poco. Delegue una tarea basada en terminal hoy, como “Configurar un nuevo repositorio de Git e impulsar mis cambios locales”. Observe cómo GPT-5.5 maneja los errores. Esto generará la confianza que necesita para delegar tareas de 20 horas al final de la semana.

❓ Preguntas frecuentes (FAQ)

El cambio más significativo es el cambio hacia el “uso agente de computadoras”. GPT-5.5 está diseñado para realizar tareas de varios pasos, como navegar por la web, administrar hojas de cálculo y depurar código de forma autónoma, en lugar de simplemente generar respuestas de texto.

GPT-5.5 logró una puntuación del 82,7% en Terminal-Bench 2.0, superando significativamente a Claude Opus 4.7 (69,4%) y Gemini 3.1 Pro (68,5%). Esto demuestra su capacidad superior para manejar flujos de trabajo complejos de línea de comandos.

Sí, el precio por token es más alto ($5/$30 por millón de tokens). Sin embargo, debido a que el modelo es más eficiente y utiliza menos tokens para completar las mismas tareas, el costo real por proyecto a menudo sigue siendo el mismo o incluso disminuye.

GPT-5.5 está actualmente disponible para suscriptores Plus ($20/mes), Pro, Business y Enterprise en ChatGPT y Codex. Se espera que el acceso a la API se lance “muy pronto”. NO está disponible para usuarios gratuitos.

GPT-5.5 Pro está diseñado para trabajos de mayor precisión e investigaciones profundas. Obtiene una puntuación significativamente más alta en puntos de referencia como BrowseComp (90,1%) para rastrear información difícil de encontrar en la web.

Según el punto de referencia GDPval en 44 ocupaciones, GPT-5.5 igualó o superó a los profesionales de la industria (abogados, analistas, gerentes de producto) en el 84,9% de todas las comparaciones.

Sí, alcanza el 58,6 % en SWE-Bench Pro para la resolución de problemas de GitHub y supera a su predecesor en el punto de referencia Expert-SWE, que imita tareas de codificación humana de largo horizonte (20 horas).

Sí, al igual que sus predecesores, GPT-5.5 es multimodal. Sin embargo, OpenAI ha centrado este lanzamiento específicamente en el razonamiento y el uso agente del ordenador para competir con el MiMo 2.5 Pro de Xiaomi.

Los modelos agentes como GPT-5.5 aumentan la superficie de ataque porque pueden manipular interfaces de computadora. Las empresas deben implementar “registros de auditoría de agentes” y límites de acción estrictos para mantener la seguridad de los datos.

Para el “trabajo real” que requiere un alto razonamiento y planificación, sí. La eficiencia del modelo significa que usted dedica menos tiempo a corregir errores de IA, lo que justifica con creces el precio por token para los usuarios profesionales.

🎯 Veredicto final y plan de acción

GPT-5.5 no es sólo un chatbot; es tu primer trabajador digital autónomo. Su inteligencia agente sin precedentes en el terminal y en el navegador marca el inicio de la revolución “Act-One”. Comience a delegar hoy para recuperar su tiempo y enfoque arquitectónico.

🚀 Su próximo paso: identifique una tarea de varios pasos de 2 horas en su computadora, como sincronizar datos entre tres plataformas SaaS, y deléguela al agente GPT-5.5 en ChatGPT Plus hoy.

No esperes el “momento perfecto”. El éxito en 2026 pertenece a quienes actúan con rapidez.

Última actualización: 23 de abril de 2026 | ¿Encontraste un error? Contacta con nuestro equipo editorial

Nick Malin Romain

Nick Malin Romain es un experto en el ecosistema digital y el creador de Ferdja.com. Su objetivo es hacer que la nueva economía numérica sea accesible para todos. A través de sus análisis de las herramientas SaaS, las criptomonedas y las estrategias de afiliación, Nick comparte una experiencia concreta para acompañar a los autónomos y emprendedores en la maîtrise du travail demain y la creación de ingresos pasivos o activos en la web.