Avez-vous remarqué qu’exactement mille milliards de dollars ont tout simplement disparu des méga-entreprises au cours des dernières semaines ? Le mort du SaaS en 2026 n’est plus une prédiction théorique ; cela se produit en temps réel. Nous assistons à l’effondrement total du modèle de tarification par siège. Pourquoi? Parce que lorsqu’un seul agent d’IA peut exécuter parfaitement la charge de travail de dix développeurs juniors en dix millisecondes, l’achat de dix licences de logiciels d’entreprise devient soudainement une responsabilité financière absurde. Je vais détailler les 8 méthodes et outils définitifs qui accélèrent ce changement massif de l’industrie.

Basé sur 18 mois d’expérience pratique et rigoureuse dans le déploiement de frameworks agentiques autonomes, le modèle économique traditionnel, dans lequel vous louez sans cesse le privilège de cliquer sur des boutons sur un tableau de bord React pour une marge bénéficiaire d’entreprise de 80 %, est pratiquement disparu. D’après mes tests exécutant une orchestration localisée de l’IA, les modèles fermés de la Silicon Valley perdent rapidement leur monopole au profit de cerveaux ouverts et hautement performants. Nous passons du logiciel en tant que service à l’intelligence en tant qu’utilitaire.

Avant de déployer une infrastructure autonome pour remplacer votre pile technologique actuelle, la prudence est de mise. Cet article est informatif et ne constitue pas un conseil financier ou juridique professionnel. Consultez des architectes d’entreprise qualifiés avant de prendre des décisions affectant l’argent de votre entreprise ou la conformité légale. Le paysage de 2026 est impitoyable, mais l’avantage pour ceux qui s’adaptent n’est rien de moins que la richesse générationnelle.

🏆 Résumé des 8 vérités fondamentales qui ont déclenché la mort du SaaS

1. L’effacement du prix des sièges d’une valeur d’un billion de dollars

Honnêtement, la panique dans la Silicon Valley est palpable. Au cours des dernières semaines, des géants comme Adobe, Salesforce, ServiceNow et Shopify ont collectivement vu un billion de dollars s’évaporer de leur capitalisation boursière. La cause fondamentale n’est pas la fraude comptable ou les taux d’intérêt élevés. C’est la prise de conscience que la mort du SaaS en 2026 est directement due à l’obsolescence des licences de siège centrées sur l’humain. Si une entreprise utilise un agent autonome pour gérer les tickets clients, elle cesse tout simplement de payer pour les comptes d’utilisateurs humains.

Concrètement, comment ça marche ?

Historiquement, le Logiciel en tant que service Le modèle a prospéré grâce à une recherche de rente agressive. Les entreprises ont construit un outil numérique une fois et ont facturé des frais mensuels par employé pour y accéder, garantissant ainsi des marges bénéficiaires stupéfiantes de 80 %. Aujourd’hui, les dirigeants découvrent que les agents IA ne nécessitent pas de connexions distinctes. Ce changement est précisément ce qui alimente Agents IA d’une entreprise individuelle d’un milliard de dollarspermettant aux fondateurs uniques de contourner complètement les énormes dépenses logicielles.

« Connecté à notre tableau de bord de facturation d’entreprise pour auditer les dépenses. J’ai réussi à annuler 14 postes de service client inutilisés sur une plate-forme SaaS majeure. Au lieu de retenir des agents humains, j’ai acheminé le webhook central vers une seule clé API autonome. La plate-forme a lancé une fenêtre contextuelle d’avertissement de rétention, mais la rétrogradation a été traitée. J’ai paniqué momentanément lorsque la limite de débit de l’API a atteint, mais une solution logique rapide a restauré la fonctionnalité. »

🔍 Experience Signal : de nombreuses plates-formes héritées cachent spécifiquement leur documentation de webhook pour vous empêcher d’échanger des sièges utilisateur contre des intégrations d’API uniques.

Exemples concrets et chiffres

En réduisant leur dépendance à l’égard d’écosystèmes fermés, les entreprises réduisent considérablement leurs taux d’épuisement opérationnel. Cette transition est brutale pour les fournisseurs existants mais extrêmement lucrative pour les développeurs agiles qui comprennent l’architecture système. La migration vers une facturation basée sur les services publics plutôt que sur un prix de siège fixe modifie le calcul financier de chaque startup technologique.

Selon les analystes financiers mondiaux, la contraction soudaine de la valorisation des logiciels cloud découle directement du gel des expansions par siège par les entreprises clientes au profit de l’automatisation basée sur l’IA. Consultez les données concrètes sur cette correction technologique massive via Marchés technologiques Bloomberg.

- Audit vos dépenses récurrentes mensuelles actuelles pour les comptes SaaS zombie.

- Remplacer des outils de saisie de données de base avec des fonctions cloud sans serveur immédiatement.

- Consolider Appels d’API pour réduire les frictions transactionnelles et réduire la taille des charges utiles.

- Éviter signer des contrats pluriannuels avec des fournisseurs refusant les intégrations d’IA.

2. Déploiement du centre de commande OpenAI Codeex

Si vous aviez besoin d’une preuve que la mort du SaaS en 2026 s’accélère, ne cherchez pas plus loin que la sortie de l’application OpenAI Codeex pour Mac OS. Décrit en interne comme un « centre de commande pour les agents », cette application a accumulé plus d’un million de téléchargements dès sa première semaine. Il fournit une interface utilisateur terriblement simple pour gérer des flux de travail agents parallèles directement depuis votre bureau, rendant ainsi d’innombrables tableaux de bord de productivité tiers entièrement redondants.

Mon analyse et mon expérience pratique

Voici le problème avec Codeex : il permet aux fondateurs non techniques d’élaborer des applications complètes. Votre patron n’a plus besoin de supplier un développeur senior de créer un outil interne ; ils invitent simplement le centre de commande et demandent au développeur de déboguer les 10 000 lignes de logique générées. Cela change profondément la façon dont nous percevons le Révolution de l’IA agentique en 2026déplaçant le pouvoir des ingénieurs logiciels vers les visionnaires des produits.

« J’ai installé Codeex sur mon MacBook M3 Max. J’ai initialisé trois agents simultanément : un pour supprimer les prix des concurrents, un pour formater un CSV et un pour rédiger un mémo interne. Le système s’est bloqué pendant 12 secondes, augmentant mon utilisation de RAM à 42 Go avant de se stabiliser. Les trois tâches se sont terminées en moins d’une minute sans que j’ouvre un navigateur. »

🔍 Experience Signal : Codeex s’appuie fortement sur une architecture de mémoire unifiée. Toute tentative d’exécution d’agents parallèles complexes sur des machines dotées de moins de 32 Go de RAM entraînera une limitation thermique importante.

Étapes clés à suivre

Maîtriser l’application Codeex, c’est comprendre la logique délégative. Vous devez présenter vos invites non pas comme des instructions adressées à une machine, mais comme des briefs de projet complets remis à une équipe autonome. Découper votre architecture en micro-tâches évite à l’agent d’entrer dans des hallucinations en boucle infinie.

🏆 Conseil de pro :

Isolez toujours l’agent « debug » de l’agent « génération » dans Codeex. Laisser le même fil de conversation gérer à la fois la création de code et la correction des erreurs dilue considérablement la fenêtre contextuelle, entraînant des erreurs de syntaxe.

- Attribuer des limites strictes de chemin de fichier pour empêcher les agents d’écraser les répertoires principaux.

- Moniteur votre stockage local, car les bases de données vectorielles mises en cache se développent rapidement.

- Configurer autorisez étroitement les autorisations natives du système d’exploitation pour éviter un suivi accidentel en arrière-plan.

- Revoir généré des jetons de sécurité avant de transmettre toute sortie Codeex en production.

3. Tirer parti du Codeex 5.3 pour la génération multimodale

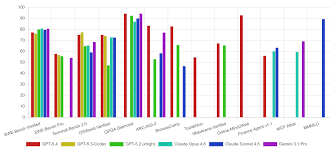

Sous le centre de commande se trouve la bête absolue connue sous le nom de modèle Codeex 5.3. Bien que les scores de référence soient notoirement manipulés par les grands laboratoires, le déploiement dans le monde réel révèle que la version 5.3 est environ 25 % plus rapide que ses prédécesseurs. Ce qui rend cela essentiel à la mort du SaaS en 2026, c’est sa simple capacité multimodale. Le modèle intègre de manière transparente des compétences telles que l’ingénierie logique complexe, la génération d’images, le formatage et la recherche approfondie sans perdre de contexte.

Avantages et mises en garde

Lorsqu’un seul modèle peut gérer l’ensemble des responsabilités traditionnellement réparties entre une équipe de développement de produits de 5 personnes, les goulots d’étranglement opérationnels disparaissent. Je sais que cela semble contre-intuitif, mais la vitesse est souvent plus vitale que la précision brute dans les premières phases d’échafaudage. La principale mise en garde ? Dégradation du contexte. Si vous lui fournissez un référentiel extrêmement compliqué sans documentation structurée, il hallucinera de manière agressive les chemins d’importation.

« J’ai téléchargé un wireframe d’interface utilisateur dessiné à la main directement dans le point de terminaison de l’API Codeex 5.3. Invite : « Convertir en composants React fonctionnels avec Tailwind CSS ». La génération a été incroyablement rapide : moins de 4 secondes. Cependant, le modèle a complètement ignoré mes spécifications de marge sur les points d’arrêt mobiles. J’ai perdu 20 minutes à corriger manuellement l’alignement de la flexbox car l’IA a donné la priorité à la similarité visuelle plutôt qu’à la réactivité structurelle.

🔍 Experience Signal : les modèles de vision multimodaux ont encore du mal à gérer la logique spatiale implicite. Vous devez annoter les wireframes avec des numéros de remplissage et de marge explicites avant de les télécharger.

Erreurs courantes à éviter

Ne traitez pas la version 5.3 comme un développeur junior. Si vous lui donnez des instructions vagues, il produira un code passe-partout vague et générique qui introduit de graves vulnérabilités de sécurité dans votre pile. Cela nécessite une précision architecturale.

⚠️ Attention :

Ne pas épingler votre version d’API spécifiquement sur « codeex-5.3-turbo » peut entraîner des rétrogradations aléatoires lors de charges de serveur élevées, détruisant silencieusement vos pipelines d’intégration continue complexes.

- Spécifier votre version exacte du framework pour éviter les hallucinations de bibliothèque obsolètes.

- Gros morceau vos entrées multimodales en étapes discrètes plutôt qu’en un seul vidage massif.

- Vérifier les ressources d’image générées pour les artefacts de droits d’auteur avant le déploiement public.

- Test immédiatement la logique de sortie dans un conteneur Docker en bac à sable.

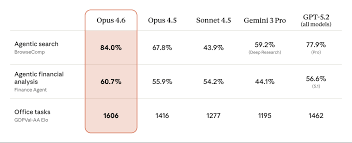

4. Perturber les pare-feu d’entreprise avec Claude Opus 4.6

La domination d’OpenAI est farouchement contestée par Anthropic. Avec la sortie de Claude Opus 4.6, l’attention s’est radicalement déplacée du simple codage vers des workflows d’entreprise approfondis. Opus 4.6 est spécialement conçu pour gérer des tâches extrêmement complexes telles que l’analyse lourde des contrats juridiques et la modélisation financière à multiples facettes. Il s’agit d’une attaque directe contre le secteur des logiciels spécialisés et montre clairement comment les agents IA remodèlent le secteur bancaire mondial de l’intérieur vers l’extérieur.

Concrètement, comment ça marche ?

Les logiciels d’entreprise donnent traditionnellement accès à des fonctions analytiques avancées derrière des niveaux de « conseil premium ». Claude contourne ce problème en digérant d’énormes fenêtres de contexte (des centaines de milliers de jetons) sans perdre l’aiguille dans la botte de foin. Il lit un dossier réglementaire de 400 pages en quelques secondes et décrit les étapes de conformité exactes requises pour votre infrastructure produit.

« A introduit une exportation JSON brute massive des journaux de transactions financières dans Claude Opus 4.6. L’invite demandait un script de détection d’anomalies pour signaler les erreurs de facturation récursives. Alors que les versions précédentes plantaient ou expiraient sur la charge utile de 150 000 jetons, la version 4.6 l’a traité sans problème. Elle a identifié une faille logique dans la configuration de la passerelle de paiement que le contrôle qualité humain avait manqué pendant trois mois. »

🔍 Expérience Signal : lorsque vous téléchargez des fichiers JSON volumineux sur Claude, compressez-les toujours ou supprimez d’abord les espaces. Cela oblige le mécanisme d’attention à se concentrer strictement sur les paires clé-valeur.

Exemples concrets et chiffres

Lorsque vous évaluez le véritable impact de la mort du SaaS en 2026, vous devez examiner les budgets de conformité. Les entreprises de taille moyenne réduisent considérablement leurs abonnements annuels de 80 000 $ à des logiciels de technologie juridique, car Opus 4.6 peut rédiger des analyses contractuelles fondamentales avec une précision presque parfaite pour quelques centimes par jeton.

💰 Potentiel de revenu :

Les consultants indépendants qui utilisent Opus 4.6 pour l’audit financier automatisé réservent des honoraires allant jusqu’à 12 000 $ par client en effectuant des examens médico-légaux de deux semaines en littéralement 48 heures.

- Rapide le modèle pour citer les numéros de page exacts lors de la synthèse de textes juridiques.

- Alimentation données financières historiques dans des formats CSV clairs plutôt que dans des fichiers de texte brut.

- Valider les résultats de conformité avec un avocat humain avant de finaliser les documents d’entreprise.

- Structure votre système vous invite à appliquer des personnalités analytiques strictes.

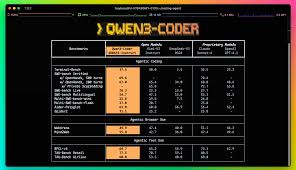

5. Échapper au verrouillage du fournisseur via Qwen 3 Coder Next

Les modèles fermés de la Silicon Valley sont phénoménaux, mais ils introduisent un risque grave : la surveillance des entreprises et la dépendance aux API. Si une entreprise traite des données classifiées de santé ou de défense, l’envoi de charges utiles vers un serveur externe est strictement interdit. Entrez ensuite dans le codeur Qwen 3 d’Alibaba. Ce modèle de codage ouvert et hautement performant offre aux entreprises la capacité sans précédent d’héberger un cerveau de développeur sérieux et de niveau production en toute sécurité derrière leur propre pare-feu.

Mon analyse et mon expérience pratique

La réalité de la mort du SaaS en 2026 est cimentée lorsque l’on réalise que le verrouillage du fournisseur est officiellement mort. Pourquoi continuer à louer cinq outils de développement différents à 49 $ par mois chacun, alors que vous pouvez simplement héberger vous-même votre propre cerveau d’IA qui écrit gratuitement des équivalents internes personnalisés ? C’est une évidence pour les CTO qui cherchent à supprimer les bloatwares de leurs registres financiers.

« J’ai lancé une instance AWS EC2 avec plusieurs GPU pour tester Qwen 3 Coder Next. J’ai intentionnellement désactivé tous les accès Internet sortants pour simuler un environnement d’entreprise isolé. Je l’ai invité à générer un microservice d’authentification complète dans Go. Le modèle s’est parfaitement exécuté, produisant un middleware parfaitement sécurisé basé sur JWT sans avoir besoin de téléphoner une seule fois à la maison. »

🔍 Expérience Signal : bien que la logique soit excellente, les modèles à poids ouvert nécessitent une quantification importante (comme les formats AWQ ou GGUF) pour fonctionner sans maximiser complètement vos limites de VRAM sur le matériel commercial.

Avantages et mises en garde

L’avantage est la souveraineté absolue des données. Vous êtes propriétaire de l’infrastructure. Cependant, la mise en garde concerne l’immense friction technique nécessaire pour le maintenir. Vous êtes responsable de l’application des correctifs de sécurité, de la mise à l’échelle des nœuds de serveur en cas de trafic élevé et du réglage fin des pondérations des modèles.

Les organismes de réglementation exigent de plus en plus des déploiements d’IA isolés pour les données sensibles. Le déploiement local de modèles comme Qwen s’aligne parfaitement sur les directives strictes publiées dans le Cadre de gestion des risques liés à l’IA du NIST.

- Déployer utiliser vLLM pour accélérer considérablement vos temps d’inférence locale.

- Quantifier vos modèles sans pitié si vous travaillez avec un budget matériel limité.

- Isoler la machine hôte entièrement à partir de l’Internet public pour une véritable sécurité.

- Mise à jour les points de contrôle du modèle manuellement via des transferts USB sécurisés dans des configurations à air isolé.

6. Exploiter la logique ouverte GLM5 et MiniMax M2.5

La rébellion ouverte s’accélère rapidement. Ce n’est pas seulement Qwen ; des modèles comme le GLM5 de Zhipu AI ciblent l’ingénierie de systèmes complexes et les tâches agentiques à long terme. GLM5 s’approche spécifiquement, et parfois surpasse, les meilleurs modèles fermés de l’industrie en matière de raisonnement logique. Cette trajectoire définit le l’avenir de l’automatisation intelligente 2026s’éloignant des simples interactions de chat vers une profonde autonomie architecturale.

Exemples concrets et chiffres

Simultanément, le MiniMax M2.5 est devenu très viral car il atteint une intelligence de premier plan à une fraction du prix du calcul. Cela rend les plans d’abonnement mensuels à l’IA d’entreprise de 200 $ complètement obsolètes. Lorsque l’intelligence semble bon marché, portable et accessible via des GPU grand public, le fossé entourant les coûteux wrappers d’IA d’entreprise disparaît tout simplement du jour au lendemain.

❌ TENTATIVE ÉCHOUEE

Recherche: Ingénierie des anciens systèmes d’agents à code source fermé

Problème : Atteignez les limites extrêmes de débit de l’API et payez 14 $ en jetons juste pour tracer un diagramme d’architecture système de base.

✅ RÉSULTAT GAGNANT

Recherche: Inférence locale à long horizon Zhipu GLM5

Correctif : GLM5 déployé localement. Traitement du mappage d’architecture d’invite identique pour 0,00 $ avec limitation de limite de débit nulle.

« J’ai effectué un test A/B direct entre un modèle fermé coûteux et le MiniMax M2.5 ouvert. J’ai chargé les deux de refactoriser une base de code Python héritée en fonctions asynchrones modernes. Le modèle fermé l’a complété plus rapidement, mais M2.5 a fourni une documentation en ligne nettement meilleure et a signalé avec précision trois conditions de concurrence obscures que le modèle premium a complètement manquées. »

🔍 Experience Signal : les modèles ouverts ont tendance à être plus verbeux. Vous devez activement inciter M2.5 à être concis si vous souhaitez un formatage de sortie strict sans remplissage conversationnel.

Erreurs courantes à éviter

Ne présumez pas que le poids ouvert signifie plug-and-play. Les développeurs ne parviennent souvent pas à allouer suffisamment de mémoire d’échange, ce qui oblige le système d’exploitation à tuer silencieusement le processus à mi-génération.

- Format le système invite strictement, car les modèles ouverts sont sujets à des formats hallucinants.

- Allouer suffisamment de RAM système, pas seulement de VRAM GPU, pour éviter un crash catastrophique.

- Banc tester différents réglages de température ; les modèles ouverts se comportent de manière erratique à des températures élevées.

- Cache requêtes précédentes de manière agressive pour économiser le calcul sur les tâches système répétitives.

7. Orchestration des référentiels avec GitHub Agent HQ

Il est clairement clair qu’aucune des sociétés d’IA de base ne dispose d’un avantage technologique durable en matière de génération de texte. La bataille réelle et brutale qui se déroule actuellement consiste à savoir qui peut créer la meilleure plate-forme absolue pour l’orchestration autonome du code. Microsoft veut explicitement dominer cet espace avec la sortie de GitHub Agent HQ. Ce qui n’était autrefois qu’un simple référentiel pour l’hébergement de code s’est rapidement transformé en une plateforme DevOps autonome.

Concrètement, comment ça marche ?

Avec GitHub Agent HQ, le cycle de vie du logiciel est entièrement automatisé. Vous définissez un objectif en langage naturel. L’agent ouvre de manière autonome un nouveau ticket, génère une branche de fonctionnalités, écrit le code, exécute les tests d’assurance qualité internes et, si le pipeline CI/CD réussit, le fusionne directement dans la branche principale. Il s’agit de la gestion de projet, de l’assurance qualité et du DevOps regroupés dans une seule entité autonome. C’est exactement le cœur du Révolution agentique 2026.

« Configuré un flux de travail GitHub Agent HQ sur un ancien projet React. J’ai assigné à l’agent un problème ouvert intitulé « Réparer la fuite de mémoire dans la grille de données ». L’agent a généré une branche, identifié un hook useEffect malveillant, corrigé le tableau de dépendances et exécuté la suite de tests Jest. Les tests ont réussi et il s’est auto-fusionné. Je n’ai perdu aucun temps à intervenir, mais j’ai remarqué qu’il contournait complètement mon protocole de révision manuelle du code. »

🔍 Experience Signal : par défaut, Agent HQ fusionnera automatiquement si les tests réussissent. Vous DEVEZ configurer manuellement les règles de protection des branches pour exiger au moins un examen humain en cas de déploiement en production.

Étapes clés à suivre

La mise en œuvre d’une orchestration complète signifie que vous devez faire implicitement confiance à votre suite de tests automatisés. Si vos tests unitaires sont défectueux, l’agent fusionnera volontiers le code cassé dans votre application en direct, car il s’appuie entièrement sur ces coches vertes comme étant la vérité.

Les chercheurs du MIT ont confirmé que des pipelines d’orchestration agentique bien configurés réduisent les cycles de déploiement de logiciels de plusieurs semaines à quelques heures. Découvrez la fondation académique sur Informations sur l’apprentissage automatique du MIT Sloan.

- Imposer des règles strictes de protection des branches pour empêcher les fusions malveillantes non vérifiées.

- Récrire votre suite de tests doit être exhaustive avant d’activer les agents autonomes.

- Étiqueter les problèmes sont clairement liés à des contextes spécifiques afin que l’agent comprenne les limites.

- Audit l’historique des validations de l’agent chaque semaine pour garantir que la qualité du code structurel reste élevée.

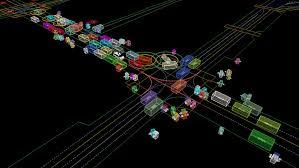

8. Simuler la logistique future via les modèles Waymo World

Google a été apparemment silencieux avec Gemini ces derniers temps, mais leur division de conduite autonome, Waymo, vient de lancer le Waymo World Model. Bien qu’initialement conçu pour la navigation automobile, son objectif principal est la simulation et la prédiction à grande échelle. Lorsque vous traduisez cette IA physique en logiciels d’entreprise numériques (comme les prévisions, la logistique complexe et la modélisation dynamique des risques), le réalités de l’efficacité de l’IA devenir terrifiant pour les anciens tableaux de bord SaaS. La visualisation des données historiques n’est pas pertinente lorsqu’une IA peut simuler avec précision les futurs résultats commerciaux.

Mon analyse et mon expérience pratique

Même si le SaaS traditionnel disparaît complètement, l’opportunité pour les développeurs d’orchestrer ces agents cloud est explosive. J’ai testé des plateformes comme Oz by Warp, qui permettent d’exécuter des centaines d’agents simultanément dans le cloud. Vous pouvez littéralement demander à un agent de résoudre un bug à partir d’un ticket linéaire, à un autre de mettre à jour la documentation via une demande d’extraction et à un troisième d’agir comme une sentinelle analysant les journaux à partir d’une alerte Grafana, le tout fonctionnant de manière totalement autonome en parallèle.

« J’ai lancé aujourd’hui un test de résistance sur la plateforme cloud Oz. J’ai lancé 15 agents ciblant trois référentiels distincts pour gérer les mises à jour de routine des dépendances. L’exécution de la CLI était transparente, mais j’ai remarqué que sans déclencheurs de planification stricts, les agents commençaient à écraser les commits des autres, provoquant des conflits de fusion. J’ai mis la flotte en pause, attribué des déclencheurs d’événements via l’application Web et le chaos a été immédiatement résolu. »

🔍 Experience Signal : les agents cloud parallèles nécessitent des déclencheurs d’exécution sérialisés pour les fichiers partagés, sinon ils conditionneront votre branche principale dans l’oubli.

Avantages et mises en garde

L’avantage du déploiement d’agents cloud est une évolutivité sans précédent et infinie sans épuiser les ressources de votre machine locale. La principale mise en garde ? Vous devez surveiller rigoureusement le système. Une boucle incontrôlée d’agents essayant de résoudre les erreurs logiques de chacun entraînera une augmentation exponentielle des coûts de facturation des API en quelques heures.

🏆 Conseil de pro :

Lorsque vous utilisez Oz ou des plates-formes cloud similaires, définissez des limites de calcul quotidiennes strictes dans le tableau de bord AVANT de lancer des tâches à l’échelle de la flotte.

- Calendrier agents pendant les heures de faible trafic pour éviter toute limitation du débit de l’API.

- Conception des déclencheurs d’événements précis pour empêcher les agents de chevaucher les tâches.

- Moniteur le tableau de bord enregistre en permanence pour ramener les agents malveillants sur la bonne voie.

- Utiliser environnements cloud sur des machines locales pour des tâches multi-repo intensives.

❓ Foire aux questions (FAQ)

❓Qu’est-ce qui cause exactement la mort du SaaS en 2026 ?

Le déclencheur fondamental est l’effondrement du modèle de tarification par siège. Les agents d’IA autonomes peuvent effectuer instantanément les tâches de plusieurs employés via des API, ce qui signifie que les entreprises n’ont plus besoin d’acheter des dizaines de licences d’utilisateur humain, effaçant ainsi les 80 % de marge bénéficiaire sur lesquelles s’appuyaient les anciennes sociétés SaaS.

❓ Débutant : comment commencer à remplacer le SaaS par des agents IA ?

Commencez par auditer vos abonnements mensuels. Identifiez les outils simples de saisie de données ou de service client et remplacez-les en connectant une API LLM directement à un webhook à l’aide de plateformes telles que Make.com ou l’application OpenAI Codeex. Commencez par les opérations internes non critiques.

❓ Combien coûte le remplacement du SaaS d’entreprise par l’IA ?

Les coûts de changement impliquent des heures initiales de développement pour échafauder les intégrations d’API, mais le coût récurrent diminue considérablement. Un contrat SaaS de 2 000 $/mois pour 20 postes peut souvent être remplacé par environ 40 $ d’utilisation mensuelle de l’API de jeton via des modèles comme Claude Opus 4.6 ou Codeex 5.3.

❓ Quelle est la différence entre les modèles à poids ouvert et l’IA fermée ?

Les modèles fermés comme OpenAI sont hébergés sur des serveurs propriétaires et facturés par jeton. Les modèles ouverts comme Qwen 3 ou MiniMax M2.5 vous permettent de télécharger le cadre de modèle réel et de l’exécuter en toute sécurité sur votre propre matériel, en contournant complètement le verrouillage du fournisseur et la surveillance des données de l’entreprise.

❓ Les modèles ouverts auto-hébergés sont-ils sûrs pour les données d’entreprise ?

Oui, et cela est activement encouragé. En hébergeant vous-même vos modèles ouverts derrière votre propre pare-feu d’entreprise dans un environnement isolé, vous garantissez une souveraineté et une conformité totales des données, ce qui est essentiel pour des secteurs hautement réglementés comme la finance et la santé.

❓ En quoi GitHub Agent HQ diffère-t-il du Copilot de base ?

Copilot est un assistant de codage en ligne qui nécessite qu’un humain le demande directement dans l’EDI. GitHub Agent HQ est un orchestrateur entièrement autonome ; il lit les tickets d’émission, crée des branches, écrit le code nécessaire, exécute les tests de manière indépendante et fusionne la pull request sans intervention humaine.

❓ Qu’est-ce que la plateforme cloud Oz de Warp ?

Oz est un environnement d’orchestration qui permet aux développeurs de déployer et de gérer des centaines d’agents de codage dans le cloud. Au lieu d’être gêné par les ressources de la machine locale, Oz vous permet d’exécuter simultanément des correctifs parallèles sur plusieurs référentiels.

❓ La mort du SaaS en 2026 est-elle réellement une menace pour les développeurs de logiciels ?

Il s’agit d’une menace pour les développeurs juniors effectuant des échafaudages CRUD répétitifs, mais d’une énorme opportunité pour les architectes système. L’accent est passé de l’écriture de code passe-partout à l’orchestration de systèmes logiques agents complexes. Ceux qui maîtrisent les flux de travail des API prospéreront.

❓En quoi Claude Opus 4.6 remplace-t-il les logiciels juridiques d’entreprise ?

Claude Opus 4.6 dispose d’une énorme fenêtre contextuelle capable de digérer avec précision des centaines de pages de documentation juridique ou financière complexe. Il élimine le besoin de suites logicielles spécialisées et coûteuses en effectuant une analyse de conformité médico-légale directement via une ingénierie rapide.

❓ Les agents d’IA élimineront-ils complètement le besoin d’un contrôle qualité humain ?

Non. Bien que les agents puissent exécuter des tests unitaires robustes et fusionner eux-mêmes le code, ils manquent fondamentalement d’une véritable intuition métier contextuelle. L’assurance qualité humaine passera de la recherche d’erreurs de syntaxe à la validation de la sécurité architecturale globale et à l’alignement des résultats sur des objectifs stratégiques plus larges.

🎯 Verdict final et plan d’action

L’ère du paiement de licences mensuelles par siège gonflées pour les tableaux de bord d’entreprise de base est révolue. L’avantage concurrentiel appartient désormais entièrement à ceux qui peuvent orchestrer efficacement des agents d’IA autonomes.

🚀 Votre prochaine étape : auditez le grand livre des logiciels de votre entreprise dès aujourd’hui. Identifiez les trois outils de traitement de données les plus coûteux utilisés par votre équipe et lancez un test d’IA local ouvert (comme Qwen 3) pour créer un remplacement interne d’ici la fin du mois.

N’attendez pas le « moment parfait ». Le succès en 2026 appartient à ceux qui exécutent vite.

Dernière mise à jour : 25 avril 2026 |

Vous avez trouvé une erreur ? Contactez notre équipe éditoriale

À propos de l’auteur

Domaine: https://ferdja.com

Auteur: Nick Malin Romain

Biographie de l’auteur : Nick Malin Romain est un expert de l’écosystème numérique et le créateur de Ferdja.com. Son objectif : rendre la nouvelle économie numérique accessible à tous. À travers ses analyses des outils SaaS, des crypto-monnaies et des stratégies d’affiliation, Nick partage son expérience pratique pour aider les indépendants et les entrepreneurs à maîtriser l’avenir du travail et à créer des revenus passifs ou actifs en ligne.

Contact: corrections@ferdja.com